点击上方 "

Python人工智能技术

"

关注,

星标或者置顶

22点24分准时推送,第一时间送达

后台回复「

大礼包

」,送你特别福利

编辑:乐乐 | 来自:量子位 | 公众号 QbitAI

上一篇:

正文

大家好,我是Python人工智能技术

医学影像,越来越需要AI的帮助了。

根据数据统计,目前我国 医学影像数据年增速在30% ,但 影 像科医生年增速却只有4% ,医生面临较大的工作压力。

那么,AI医学影像市场发展得如何呢?

AI影像行业,是人工智能在医疗领域里面探索最久的赛道之一,近年来人工智能辅助诊断三类证的获批数量持续增长,整个人工智能医学影像市场预计会在 4年左右的时间突破百亿 ,保持高增长。

参考亿欧智库发布的【2023年中国人工智能医学影像产品生态路线研究报告】,2023年我国AI医学影像市场规模为24亿元,2030年将达到 137.4亿元,年复合增长率为33.8%。

虽然有了AI帮忙,能提升诊疗效率、改善患者就医体验,但同时也带来一个问题:

医院对于医学影像系统的花费越来越高了,患者看病的成本也大幅提高。

所以在这个技术飞速进步的时代,医院不是简单采用新技术就能造福患者的,也要综合考虑投入产出,才能关怀到每个病人。

在这样的背景下,医学影像系统 如何在满足功能、性能需求的同时降低总体拥有成本 (TCO) ,就成了关键问题。

以 东软智慧医学影像信息系统PACS/RIS 为例,该系统提供了覆盖检查预约、到诊排队、用药管理、检查管理、影像诊断等在内的一体融合全医学影像管理能力,可辅助医生更好地开展工作。东软在新一代的PACS/RIS产品中,就 采用了基于CPU的方案运行三维可视化、AI推理等工作负载 。

在三维可视化加持下,融合影像分析等技术,让医务人员通过旋转、缩放、分割、图像增强等操作,从多角度清晰了解到医学影像中各结构之间的空间位置关系,在疾病诊断的可视化、术前评估、手术规划、手术实时指导等方面发挥重要价值。

要知道三维可视化、AI推理都是非常吃硬件性能的,好在经过指令集、软件等方面做性能优化后,东软将PACS/RIS系统的 三维可视化效率提升达2.45倍 , AI推理性能提升高达8.49倍 ,并有效地控制了成本。

到这里看似圆满结局了,但其实过程中还有更多的细节更值得关注和借鉴,比如 系统性能是如何优化提升上去的 , CPU又为什么是破局的关键 ?

性能如何搞上去?

东软集团相信大家并不陌生,作为中国第一家上市软件公司,在医疗健康领域已深耕多年。

这次他们之所以选择英特尔当合作伙伴,正是因为在三维可视化和AI推理这两大性能杀手面前, 第五代英特尔 ® 至强 ® 可扩展处理器拥有两大法宝 :

OpenMP与SSE4 指令集 (Streaming SIMD Extensions 4) ,和 英特尔 ® AMX加速器 。

首先来看三维可视化部分。

东软主要采用了 体渲染 (Volume Rendering) 技术,通过OpenMP与SSE4指令集支持光线合成的实现。

SSE4指令集 不仅扩展了Intel ® 64指令集架构,还 加入了图形、视频编码及处理、三维成像等方面的指令 ,使涉及音频、图像和数据压缩算法的应用程序性能大幅提升。

为了找出执行三维可视化任务时,其产品在部分应用中性能不足的瓶颈所在,东软使用了英特尔提供的VTune™ Profiler工具,最终确定了 瓶颈函数SafeGradz 。该函数主要利用SSE4指令集进行三线性插值,从而实现光线上点的梯度计算。通过对该函数的代码进行优化,东软成功提升了三维可视化应用的性能。

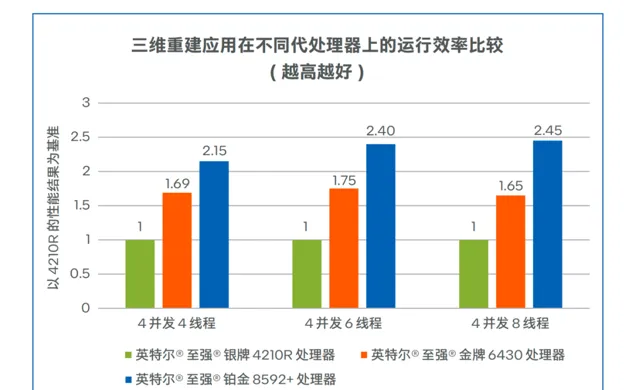

在不同代英特尔 ® 至强 ® 可扩展处理器上进行测试,结果显示,在处理器开通4并发8线程时,第五代英特尔 ® 至强 ® 铂金8592+处理器的三维重建效率,相比第二代的英特尔 ® 至强 ® 银牌4210R处理器 提升达2.45倍,让三维影像的交互更加流畅顺 滑 。

值得注意的是, 第五代英特尔 ® 至强 ® 铂金 8592+的主频为 1.90 GHz ,比 第二代英特尔 ® 至强 ® 银牌4210 R的 2.40 GHz 主频 还要 低。

更进一步说明了,性能提升靠的不是主频提升,而是靠适合工作负载的指令集和各种优化工作。

接下来看AI推理部分, 同样 用这两款CPU做对比。

东软借助处理器内置的英特尔 ® AMX (高级矩阵扩展) 技术,让CPU也能轻松驾驭深度学习任务。

英特尔 ® AMX 针对广泛的硬件和软件进行了优化,在前代VNNI和BF16技术的基础上,进一步增强了矩阵计算能力, 最大限度地利用计算资源,改善高速缓存利用率,避免潜在的带宽瓶颈 。

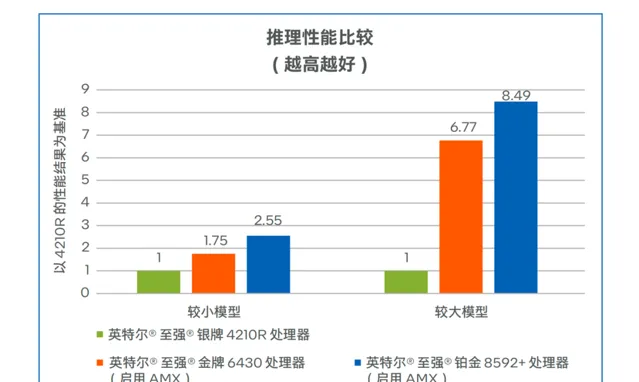

东软在第二代/第四代/第五代英特尔 ® 至强 ® 可扩展处理器上,测试了不同参数规模的AI模型在同步和异步模式下的推理表现。

测试数据显示,对于参数量为 31,185,568 的较大模型,在BF16精度和异步模式下,第五代英特尔 ® 至强 ® 铂金8592+处理器相比第二代英特尔 ® 至强 ® 银牌4210R处理器, 推理性能提升高达8.49倍 。这意味着AI辅助诊断能以更快的速度为医生提供洞见。

之所以选择第五代英特尔 ® 至强 ® 可扩展处理器,除了其本身性能够强之外,还有一些额外的好处。

比如辅以英特尔提供的OpenVINO™ 工具套件优化和部署各类模型,还可跨英特尔 ® 硬件扩展计算机视觉和非视觉工作负载,从而大幅提高性能,达到软硬协同的效果。

又比如第五代至强 ® 与上一代产品在软件和平台上兼容,因此在部署新系统时可以大大减少测试和验证工作。

……

在减少测试和验证这里,其实也起到一些节省成本的效果了。

不过在省钱这件事上,除了与具体技术优化相关,还有更多行业经验可以分享。

成本怎么打下来

其实医疗行业在选择硬件这件事上, CPU早已成为各大玩家们眼中的「香饽饽」 。

原因也是很简单,GPU固然在性能方面存在一定的优势,但「硬伤」也是比较明显,那便是成本过高。

并且从宏观角度来看,大模型的火热确实催动了GPU需求的激增,在训练阶段尤甚;但现如今到了以推理为主的阶段,如何能让AI「快好省」地用起来成为了关键点。在部署时盲目堆GPU不仅可能会造成算力过剩,出现「大炮打蚊子」的现象,更是会导致成本的「水涨船高」。

而诸如第五代英特尔 ® 至强 ® 这样的高端CPU,不仅能够很好地跟上性能的脚步,在成本的控制方面也是给出了满足成本条件的更加可行、更符合实际的方案。

一言蔽之, 高性价比 才是关键中的关键。

其次,CPU也算找准了「赛道」——部分医疗场景的AI推理具备批处理特性,对AI推理时延性能不敏感,更适合采用CPU进行推理。

具体到性能方面,第五代英特尔 ® 至强 ® 的「打开方式」是这样的:

整体性能提升:21%

推理性能提升:42%

内存速度提升:16%

三级缓存提升:2.7倍

每瓦性能提升:10倍

也正因如此,第五代英特尔 ® 至强 ® 在处理多样化的任务负载时,可以显著提升每瓦特性能,尤其在人工智能、数据中心管理、网络操作和科学计算领域,而且还能显著降低 总体拥有成本 (TCO) 。

而这也还仅是东软等医疗行业选择CPU的原因之一, 广泛的兼容性和成熟的技术 也是不可忽视的。

众所周知,CPU技术的发展相对来说较为成熟,几乎所有软件应用和操作系统都能在CPU上良好运行。

而在医疗行业中,存在大量基于传统架构开发的软件,这些软件通常设计为在标准的CPU上运行。因此,使用CPU可以确保与现有系统和软件的广泛兼容性。

其次,CPU 易于维护和升级 也是重要的一点,而GPU在这方面会显得更为复杂。医疗行业依赖于稳定运行的系统来保证服务的连续性,因此更倾向于选择维护简便、升级路径明确的硬件解决方案。

加之CPU早已在医疗行业上岗,广泛用于电子病历系统、医院资源规划系统等,培养出成熟的技术团队,也建立了完善的采购流程。

因此,为什么医疗行业青睐于CPU、为什么越来越多的人会选择CPU做AI推理,也就不难理解了。

在这一点上,或许也正应了英特尔CEO帕特·基辛格曾经表达过的观点:

从经济学的角度看推理应用的话,很多客户并不需要高端的GPU设备,因为它成本太高、耗电太多,并且需要构建新的技术架构,增加IT设施,一切都是全新的挑战。

如果我能在标准版的英特尔芯片上运行AI应用且满足需求,就不会出现这些问题。

能用起来才是硬道理

如果说东软选择第五代英特尔 ® 至强 ® 这件事是一个「点」,它其实能够带出来的是一个更大的「面」——

技术,需得广泛用起来,这才是硬道理。

诚然现在是以大模型为主流的时代,但回看2023年至今的发展,其实也是在印证着这一点。

起初大模型的发展先是掀起了以训练为主的百模大战,而后又迅速转向了推理阶段,也就是技术要落地。

到了今年,这一趋势也是越发明显,不论是OpenAI、谷歌等巨头,还是乘AIGC东风起家的初创,都在发力于如何让AIGC更好地用起来。

一言蔽之,现在已然是 应用为王 的阶段。

而要让前沿技术做到真正落地,就必须要在性能和成本之间做好平衡;或许这也正是近期国内大厂们掀起疯狂「价格战」的原因之一。

但无论AI如何发展, 算力 ,永远是绕不开的一个话题。

因此,站在现在这个「AI一日,人间一年」的时代,纵使技术日新月异,要想让它们广泛被用起来,性能和成本之间的这杆秤,需是得从最底层的基础设施抓起。

而东软和英特尔的合作模式,是一个可以值得借鉴的「范本」了。

最后让我们打个小广告:为了科普CPU在AI推理新时代的玩法,量子位开设了【最「in」AI】专栏,将从技术科普、行业案例、实战优化等多个角度全面解读。

我们希望通过这个专栏,让更多的人了解CPU在AI推理加速,甚至是整个AI平台或全流程加速上的实践成果,重点就是如何更好地利用CPU来提升大模型应用的性能和效率。

参考链接:

[1]https://www.intel.cn/content/www/cn/zh/artificial-intelligence/neusoft-pacs-ris-solution.html

[2]https://www.intel.cn/content/www/cn/zh/artificial-intelligence/ai-guidebook-healthcare.html

[3]亿欧智库【2023年中国人工智能医学影像产品生态路线研究报告】https://www.iyiou.com/analysis/202401101048186

为了跟上AI时代我干了一件事儿,我创建了一个知识星球社群:ChartGPT与副业。想带着大家一起探索 ChatGPT和新的AI时代 。

有很多小伙伴搞不定ChatGPT账号,于是我们决定,凡是这三天之内加入ChatPGT的小伙伴,我们直接送一个正常可用的永久ChatGPT独立账户。

不光是增长速度最快,我们的星球品质也绝对经得起考验,短短一个月时间,我们的课程团队发布了 8个专栏、18个副业项目 :

简单说下这个星球能给大家提供什么:

1、不断分享如何使用ChatGPT来完成各种任务,让你更高效地使用ChatGPT,以及副业思考、变现思路、创业案例、落地案例分享。

2、分享ChatGPT的使用方法、最新资讯、商业价值。

3、探讨未来关于ChatGPT的机遇,共同成长。

4、帮助大家解决ChatGPT遇到的问题。

5、 提供一整年的售后服务,一起搞副业

星球福利:

1、加入星球4天后,就送ChatGPT独立账号。

2、邀请你加入ChatGPT会员交流群。

3、赠送一份完整的ChatGPT手册和66个ChatGPT副业赚钱手册。

其它福利还在筹划中... 不过,我给你大家保证,加入星球后,收获的价值会远远大于今天加入的门票费用 !

本星球第一期原价 399 ,目前属于试运营,早鸟价 169 ,每超过50人涨价10元,星球马上要来一波大的涨价,如果你还在犹豫,可能最后就要以 更高价格加入了 。。

早就是优势。建议大家尽早以便宜的价格加入!

欢迎有需要的同学试试,如果本文对您有帮助,也请帮忙点个 赞 + 在看 啦!❤️

在 还有更多优质项目系统学习资源,欢迎分享给其他同学吧!

你还有什

么想要补充的吗?

免责声明:本文内容来源于网络,文章版权归原作者所有,意在传播相关技术知识&行业趋势,供大家学习交流,若涉及作品版权问题,请联系删除或授权事宜。

技术君个人微信

添加技术君个人微信即送一份惊喜大礼包

→ 技术资料共享

→ 技术交流社群

--END--

往日热文:

Python程序员深度学习的「四大名著」:

这四本书着实很不错!我们都知道现在机器学习、深度学习的资料太多了,面对海量资源,往往陷入到「无从下手」的困惑出境。而且并非所有的书籍都是优质资源,浪费大量的时间是得不偿失的。给大家推荐这几本好书并做简单介绍。

获得方式:

1.扫码关注本公众号

2.后台回复关键词:名著

▲长按扫描关注,回复名著即可获取