实时视频生成已经实现! 十倍加速 开源SORA!

本期讲的内容都是干货,帮你少关注点无用信息!

今天给大家分享一个关于视频生成的新技术—— Pyramid Attention Broadcast(PAB) 。

这项技术是由新加坡国立大学和普渡大学的研究团队共同开发,致力于提升 基于DiT 的实时视频生成性能。

下面是团队演示的原始方法与应用PAB的视频生成速度的比较。

还是能够很明显地感受到生成速度上的提升。

技术背景

自从OpenAI公司向大众展示了SOAR模型,我们第一次感受到了AI视频生成的强大能力所带来的震撼,于是............

没错.......没有了下文......

至今我们都没有见到模型的公开发布......

想必大家

等的

花都谢了

🥀

这不研究团队们为此献计啦😂😂😂

这类模型由于在推理阶段 耗时较长 ,常常需要大量的时间来生成单个视频。

这 大大限制 了其在实际应用中的普及。

加速这类模型的推理过程变得 尤为重要 。

技术要点

研究团队通过研究注意力机制在视频扩散变压器中的表现发现:

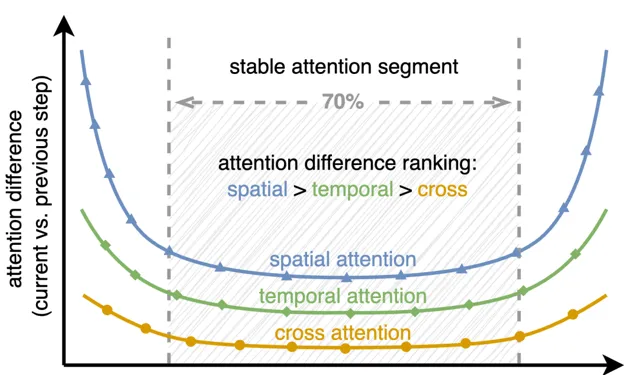

在整个推理过程中,注意力在时间步长上的变化呈现出 U型分布 ——前15%和最后15%的步长变化显著,而中间70%的步长变化较小。

基于这一观察,研究团队提出 金字塔注意力广播技术 。

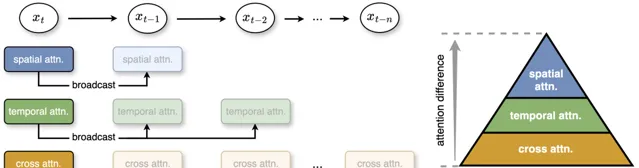

具体来说,在变化较小的中间阶段将一个时间步的注意力输出广播到多个后续步长,从而 避免重复计算 。

这种策略不仅 减少了计算成本 ,还在 不牺牲生成质量 的前提下,实现了 最高35% 的速度提升。

文章中对此金字塔结构的解释为:

根据三种注意力的差异性,为它们设置不同的广播范围。注意力差异越小,广播范围越广。

在运行时,我们将注意力结果广播到接下来的几个步骤,以避免重复的注意力计算。Xt指的是时间步的特征t。

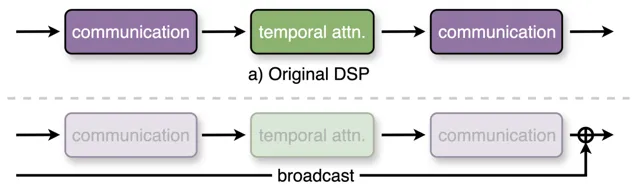

此外,团队还改进了动态序列并行(DSP)方法,通过广播时间注意力, 消除了原有的通信开销 ,进一步提升了生成速度。

技术表现

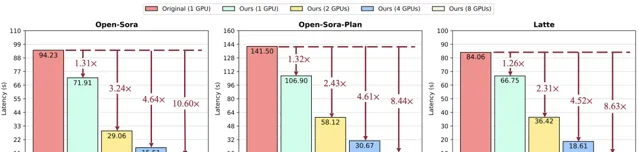

通过实验,PAB在8个NVIDIA H100 GPU上进行测试,显示出显著的加速效果。

单GPU情况下,速度提升 约1.26到1.32倍 ;

多GPU情况下,速度提升 最高可达10.6倍!

不可思议的进步,多亏了PBA的加持呀。

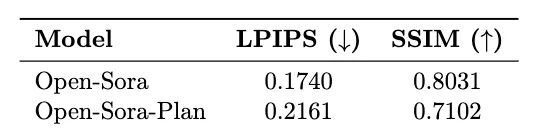

同时三个模型在LPIPS以及SSIM上的结果表现也均有所改善。

下面三个视频分别为 Open-Sora、Open-Sora-Plan 和 Latte 三个模型使用原始方法与PBA的效果对比。

PBA在不同的 GPU 数量下都实现了明显的FPS 加速.

项目链接: https://oahzxl.github.io/PAB/

总结

金字塔注意力广播技术为实时视频生成带来了新的突破, 无需训练 即可大幅提升生成速度,为未来 基于DiT 的视频生成模型赋予了更强的实时能力。

技术的突破固然重要,但未来模型的成功发布将会更加激动人心🥳🥳

小编也狠狠de期待住了🤩🤩

相信这项技术将为生成式AI应用打开新的大门。

大家有任何想法与问题,欢迎在评论区留言哦!

扫码加入AI交流群

获得更多技术支持和交流

关注「 向量光年 」公众号

加速全行业向AI的改变

关注「 开源AI项目落地 」公众号

与AI时代更靠近一点

关注「 AGI光年 」公众号

获取每日最新咨询