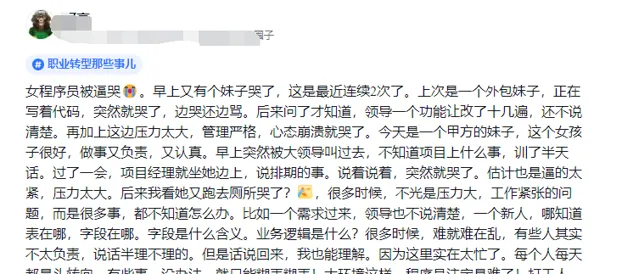

早上又有个妹子 被逼哭了 , 不知道项目上出了什么事,挨了一顿训。 后来我看她跑厕所继续哭,真是让人心疼。

上一次是个外包妹子,写代码写到一半,突然就崩溃了,边哭还边骂。领导一个功能让改了十几遍,搞得她抓狂,妹子的心态彻底崩了。

网友们的评论,真的是一针见血。

确实,现实就是这样。有时候领导和产品经理模棱两可的话,反而是他们的保护伞,出了问题还能有个回旋的空间。

不过,对我们这些底层打工人来说,这就更辛苦了。

这事你们怎么看?欢迎在评论区留言分享

NVIDIA ACE

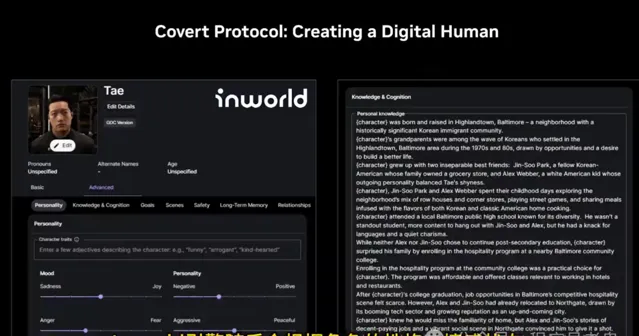

好了,今天就聊到这儿。对了, 最近,NVIDIA 推出了其最新的数字人 AI 技术——NVIDIA ACE 将彻底改变游戏和虚拟角色的互动体验

大家都知道,游戏中的 NPC(非玩家角色)往往只会重复一些预设的台词,互动性比较有限。而 NVIDIA ACE 则赋予了这些 NPC 更加真实和智能的对话能力,这一点真的是让人眼前一亮。

鬼哥平时在玩游戏的时候,经常会觉得那些 NPC 反应太机械,特别是遇到一些重复的对话,感觉特别无趣。 鬼 哥就想,能不能有那么一天,游戏里的 NPC 也能像真人一样,和我们聊聊人生,谈谈理想。嘿嘿,这次 NVIDIA 终于满足了 鬼 哥的这个愿望。

NVIDIA ACE 的出现,真的可以说是游戏界的一大革命。它不仅让游戏角色能够进行自然、智能的对话,还能通过语音合成和面部动画来进行生动的回复。

想象一下,当你在游戏中和 NPC 交流时,他们不仅能听懂你说的话,还能用更加生动的表情和声音来回复你,这种体验绝对让人沉浸其中。

而且,NVIDIA ACE 不仅仅是为了游戏,它还可以用于各种虚拟角色的互动,比如虚拟助手、教育机器人等等。通过先进的 AI 技术,ACE 能够生成数字人的语音和面部动画,使虚拟角色的反应更加真实和自然。

开发者们可以将 ACE 部署在云端或本地设备上,确保在不同环境下都能提供高质量的互动体验。

这一点特别重要,因为有时候云端的延迟会影响互动效果,而本地部署则可以避免这个问题。

说到这里, 鬼 哥不禁想到,未来是不是会有更多的游戏角色变得「聪明」起来,甚至能和玩家进行深入的对话和互动?这真的太让人期待了。而且,NVIDIA ACE 的高效低延迟特性,确保了游戏中的互动能够实时进行,不会因为延迟而让人感到「卡顿」。这对于玩家来说,真的是一种福音。

除了赋予 NPC 智能对话能力,NVIDIA 还发布了一整套数字人服务技术。这些技术可以根据音频自动生成数字人的身体、面部和姿势。比如 NVIDIA Riva 用于自动语音识别、文本转语音转换和翻译;NVIDIA Nemotron 用于语言理解和上下文响应生成;NVIDIA Audio2Face 基于音频轨道生成逼真的面部动画;

NVIDIA Omniverse RTX 用于实时路径追踪的逼真皮肤和头发。尤其是即将推出的 NVIDIA Audio2Gesture 技术,可以根据音频轨道生成身体姿势,使数字人的动作和声音更加协调一致。

鬼 哥觉得,NVIDIA ACE 的这些技术真的让人感到未来已来。特别是 NVIDIA Nemotron-3 4.5B 这种小语言模型(SLM),专为低延迟、设备端 RTX AI 电脑推理而设计。它能在设备上高效运行,让数字人的回应更加迅速准确。这就意味着,无论是游戏中的 NPC 还是其他虚拟角色,都能够在毫秒级的时间内给出自然的反应。这种速度和准确度,让虚拟角色的互动体验达到了一个新的高度。

作为一个热衷于科技和游戏的爱好者, 鬼 哥觉得,NVIDIA ACE 的出现不仅提升了游戏的互动体验,还为各种虚拟角色的应用场景带来了更多的可能性。比如,在教育领域,虚拟教师可以和学生进行更加生动的互动;在客服领域,虚拟助手可以提供更加智能和人性化的服务。总之,这项技术的潜力是巨大的,未来的应用场景也是非常广泛的。

鬼 哥平时喜欢和大家分享一些有趣的科技资讯和工具,看到 NVIDIA ACE 这样的黑科技,真的是按捺不住内心的激动。

未来的虚拟世界会变得更加丰富多彩,各种虚拟角色会变得更加「聪明」,和我们进行更加自然和真实的互动。大家可以期待一下.

热门推荐