功能机时代,人们通过物理按键点按的方式与 手机 进行交互。到了智能手机时代,人机交互的方式变为了多点触控。随着5G技术的普及,智能手机将作为万物互联的起点,与不同设备进行协同工作。

如果将上述这套说辞套用到汽车的车机上,其实也同样适用。在特斯拉Model S问世之前,传统汽车的车机可以分为两个阶段:纯物理按键和屏幕+按键。

在这一阶段,人车的交互方式类似于功能机,更多的是点击物理按键。此时此刻,传统车机还不具备智能化的服务和功能。

特斯拉Model S诞生后,正式开启了汽车大屏车机时代。也就是那时,人车交互方式从原先的点击物理按键逐步变为触屏操作,同时赋予了车载系统一定的智能属性。

新能源发展初期,绝大多数车企旗下的车型依旧只是配备了传统车机,为了帮助这部分车企解决汽车车机不够智能的问题,各大手机厂商分别推出了不同的手车互联的软件,例如苹果CarPlay、华为HiCar、小米CarWith等。

后来,随着手机厂商纷纷入局新能源汽车市场,以及传统车企发力新能源车型,再加上受特斯拉影响,现在的车机大多以「大号平板」的形态呈现,以往的功能项物理按键也被集成在了触屏操作逻辑的智能车机中。

现在的智能车机,除了可以设置汽车相关功能外,还能够安装部分手机或平板的应用,实现了观影、游戏等功能。这不禁让人产生了疑惑,车机智能化的方向是不是智能手机或平板化?现在的智能车机体验下来,给人的感觉更像是「大号青春版」智能手机或平板。

事实上,以平板形态呈现的智能车机只是过渡方案。我们可以从手机厂商或造车新势力的智能车机上,推导出车机智能化的最终形态。

此前,理想宣布旗下所有车型的车机将接入自研的AI大语言模型——Mind GPT,语音助手理想同学将变得更加智能,不仅支持语音AI绘图,还可以讲笑话、科普知识等。

或许你会觉得这是一件很傻的事情,谁会在车机上进行AI绘画?又有多少人会在车里用到这些AI相关的功能?我们都知道,智能手机作为人们日常生活中不可或缺的工具,在AI大语言模型的加持下,可以帮助用户提高工作效率,或者辅助用户进行创作。

与之相反,汽车是人们生活中的代步工具,其内置的智能车机更多的是辅助车主完成一些车内的设置或辅助驾驶,只有在停车等人的状态下,车主才可能会使用智能车机的娱乐功能,比如看电影或者玩些休闲游戏,以此来打发时间。这样一想,是不是更觉得理想车机接入GPT有点「画蛇添足」了?

然而并非如此。AI大语言模型带来的核心升级点在于机器对人类语义的理解。举个例子,以往我们在和某平台智能客服咨询问题时,往往会自动弹出几条预先设置好的问题选项,当你发现自己想要提问的问题不在那些选项中时,通常会将问题以文字的形式发送给智能客服,结果智能客服无法回答超出预设置好的问题,最后你只能选择转接人工客服。

现在,凡是接入GPT的智能客服,无需提前设置好问题,单凭AI对客户语义的理解,就可以直接以自然的方式解答客户反馈的问题。

而理想在自家车机中接入自研GPT,其真正的目的可能是强化理想同学的语音识别率,以及与用户对话的理解能力。像AI绘图、AI讲笑话等只是AI附带的功能,理想可能想要通过这些功能,让用户觉得理想同学变得更聪明了。

讲到人车的语音交互,就不得不提一嘴百度与吉利深度合作的智能电车极越01。这款智能电车支持车内外的语音控制功能,需要用户事先录入声音信息,这样极越01就可以通过声纹认证来识别车主身份。

极越01内置的语音助手「SIMO」可以精准识别车主发出的长语音指令,不管是车内和车外它都可以做到快速响应。而且SIMO首次唤醒后,车主每次与之交互时无需再喊其名字,直接语音发送指令,SIMO就可以识别这段指令并执行。正因如此,官方将其定义为汽车新物种,汽车中的机器人。

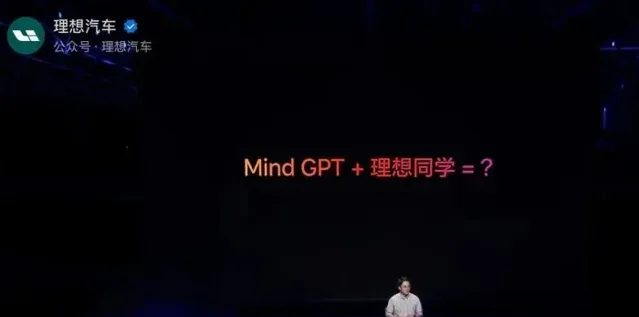

按照这个思路,我们不妨试想一下,当L5级别的辅助驾驶落地后,汽车不再需要方向盘,也不再需要平板形态的车机,用户想要与汽车进行交互,直接对话车内的AI即可。由AI全程驾驶汽车,用户通过MR的方式在车内娱乐,这或许才是车机智能化的最终形态。

受限于技术,现在的智能车机交互无非就两种:触屏和语音。但是,随着AI技术的越发成熟,人车的交互方式也在不断扩展和升级。

前不久,索尼在CES上展示了与本田合作的纯电轿车——AFEELA。有意思的地方在于AFEELA支持PS5手柄的远程遥控,这就跟小时候玩的电动遥控汽车玩具一样,摇杆向前推动,AFEELA也会跟着向前移动,摇杆向后推,AFEELA便会向后倒车。

现阶段的智能电车,虽然可以借助高阶辅助驾驶的自动泊车、自动召唤功能,让汽车自己完成停车和迎接车主,但是实际用起来,这些功能的可用度并不是很高。在高阶智驾足够成熟之前,索尼这套手柄远程控车的方案可行性会更高,前提条件是需要极低的延迟、极好的网络环境。

除索尼外,荣耀也在积极探索人车交互更多的可能性。此前,荣耀在今年的MWC上展示了一项AI黑科技——眼动控车。从发布会的演示片中可以看出,只要将人眼对准 荣耀Magic 6 Pro的前置摄像头,随着人眼视线的移动,车子也会随之移动。

就目前来看,荣耀的眼动控车需要依托于荣耀Magic 6 Pro的眼动控制和前置摄像头,实时捕捉人眼运动轨迹和焦点,通过AI算法来判断用户眼睛停留在哪个选项,然后手机将这一信号传递给车机,最后由车机来调用汽车的动力。

不管是索尼还是荣耀,手柄控车还是眼动控车,这些全新的人车交互方式,都处在第一步。它们的实现方式都需要不同的载体作为向车机传递信号的「中转站」。

未来,人在车外,人车交互方式应该是不需要用户使用任何工具,也无需与车机的AI语音对话,汽车通过外部的摄像头和感知元件,自动识别当前所处环境,车机内置的AI根据车主的行为进行预判,比如当车主在车外开始移动时,车机会自动判断是否跟随或者停留。

还有一种人车的交互方式,那就是AR HUD。像华为问界M9、极氪007等就已经搭载了这项技术。AR HUD是抬头显示的一种,主要是将一些信息投屏到汽车前面的挡风玻璃,例如导航路线,可以防止车主在驾驶期间低头,实现盲操作,进一步提升了驾驶汽车的安全性。

不过,现阶段的AR HUD,分辨率、亮度、清晰度都还远远不够,在一些大光比的环境下,车主很难看清AR HUD所显示的信息。

其实随着汽车智能化的高度发展,厂商们在人车交互的硬件上也做出了很多思考和探索。好比阿维塔12可供用户选装的电子后视镜。传统汽车司机想要看清后方车辆时,需要事先手动调整好后视镜的位置,然后还需要车主将视线短暂移至窗外。

现在,你只需要将视线移至车内左前或者右前方的电子屏幕,就可以实时查看后方车辆的位置。

但是,受限于摄像头传感器,电子后视镜的视野范围偏窄,即便支持广角/近景的焦距切换,但每次切换摄像头都要重新对焦,这也就意味着在切换过程中,电子后视镜会出现短暂的虚焦,而且到了晚上,由于光线的不足,电子后视镜所拍摄的画面也会变得比较模糊。虽然电子后视镜设计之初的出发点很好,但现阶段的实用价值并不高。

未来,汽车或许不再需要后视镜,单凭车身外部多颗感知元件和摄像头,以及车身内部的AI车机就可以实现对周边环境的感知,甚至可以提前预判。当后视镜消失之时,自然也就不再需要驾驶员了,全程交给AI接管即可。

为了降低车身的风阻,很多车企推出了隐藏式电动门把手,稍微极端点地直接取消门把手,改用触控按钮设计。伸手-拉开-关闭这三步是我们在打开/关闭传统汽车车门的必要操作。现在我们和车门之间的交互变得更加优雅,按下-踩刹车,车门自动关闭,省去了你再用手关车门这一步骤。

与取消车门门把手的设计相比,隐藏式门把手在现实生活中并没有那么好用,尤其是在冬季,隐藏式门把手很容易被冻住,导致车主无法开启车门。哪怕在非冬季使用,隐藏式门把手也会经常出现无法弹出的问题。

两种设计一对比会发现,取消门把手的设计会更贴合未来,当AI变得足够聪明时,触摸按键将被取消,汽车会自动识别车主身份,并判断是否开启车门,车主上车后,车门自动关闭,整个过程十分无感和顺畅。

我们都知道,科技是要化繁为简,为人们带来便利。如果按照这个思路,上述所有人车交互,最终会变为无感知的、完成度极高的的AI交互。当一辆汽车拥有人类思考方式,你可以将自己的生命放心交给它,让它来驾驶时,这或许才是人车交互的最佳方案。

其实,L5级别的智驾已经有相关车型出来了。早在2021年,百度便发布了L5级别智驾的汽车机器人鸥翼门Apollo。这辆车没有方向盘,也没有任何加速和刹车的脚踏板。由于现在L5级别的汽车成本较高,再加上相关的政策没有下来。所以,消费级L5级别的智能汽车可能要等到2040年之后。

因为去年11月,工信部、信息部、公安部、住房和城乡建设部才刚公布关于L3、L4级别的汽车试点相关规定。

不过,目前搭载高阶智驾的汽车绝大多数还停在L2的级别,今年可能会出现L3级别的汽车,至于L4级别的汽车可能要等到2027年之后。

所以,现在的智能车机,交互方式与平板或手机类似,因为受限于相关管理规定,厂商们想到的过渡方案罢了。汽车真正的智能化方向,一定是像百度Apollo那样的,无方向盘、无脚踏板、无车门把手、无后视镜,只有L5级别的自动驾驶以及AI。未来的人车交互方式,也只是需要动动嘴皮,其他全部交给AI。

END

都看到这里了,拜托点赞+「在看」