每天都会看很多的开源项目

这个项目可能是近期看到最惊艳的一个了 ,让我迫不及待地想去分享给大家

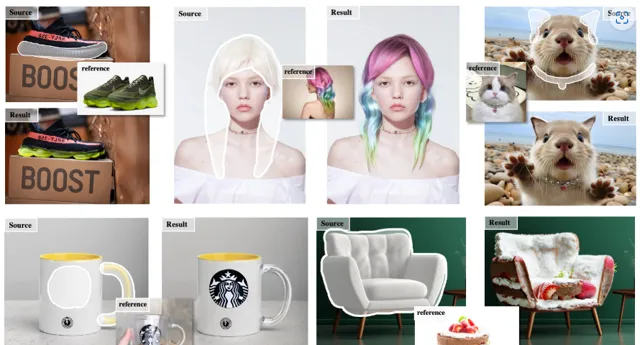

你很难想象自己换发型、换发色会变成什么样子,也很难想象一个沙发形状的蛋糕会是什么样,这个最新的开源项目 MimicBrush 将会满足你所有的幻想

倒不是说局部重绘有多么新颖,毕竟大家用的AI绘图软件都有这个功能,Mijourney、Stable Diffusion、Dalle3这些都可以,不过重绘也是用AI把这部分重新创造,抽卡把人都抽麻了还得不到自己想要的样子

而 MimicBrush 让AI真正的懂了你要重绘的内容 ,让图片真的变成你想要的样子

扫码加入AI交流群

获得更多技术支持和交流

(请注明自己的职业)

直接切入主题

我们先来看一段官方的演示视频

是不是感觉很神奇,

我们脑海里所有的天马行空,居然都可以变成可以看得到的图像

最近各地天气挺热,恰好我这几天想买个草帽戴着遮阳,实在是不知道戴上什么样,不如就直接用 MimicBrush 实际戴上看看

实际体验下来还挺有趣的, 试用链接 在下面,你们也可以直接去玩一下

https://huggingface.co/spaces/xichenhku/MimicBrush

这就会有很多 商用场景

比如,发型设计师提前让顾客看到自己染发后的样子,卖项链的商家可以让顾客先戴上看看,都可以让顾客的体验感更好

这个功能完全可以做成一个软件,给很多行业的商家都解决了用户预体验的问题

下面讲点这个开源项目

专业一些的内容

项目简介

MimicBrush 是一个用于零样本图像编辑的工具,通过参考图像实现高效的图像编辑。

它采用双 U-Nets 模型,结合稳定扩散和深度模型技术,使用户能够对上传的源图像进行指定区域的编辑,并通过参考图像模仿实现自然过渡。MimicBrush 的核心基于 IP-Adapter 和 MagicAnimate 项目,提供了灵活的编辑体验。

方法

MimicBrush的 主要结构包括模仿U-Net、参考U-Net和深度模型:

·模仿U-Net: 基于SD-1.5填充模型,接收13通道的输入,包括图像潜变量、二进制掩码、背景潜变量和深度潜变量

·参考U-Net: 从SD-1.5模型初始化,提取参考图像的多级特征,辅助模仿U-Net进行区域填充

·深度模型: 使用Depth Anything预测未掩盖源图像的深度图,并通过训练投影器将其投影到深度潜变量中,作为形状控制

具体的部署,可以到github链接readme部分去看下,这么好用的功能,希望可以早点让更多普通用户能体验

项目链接

https://github.com/ali-vilab/MimicBrush

关注「 开源AI项目落地 」公众号

与AI时代更靠近一点

关注「 AGI光年 」公众号

获取每日最新资讯