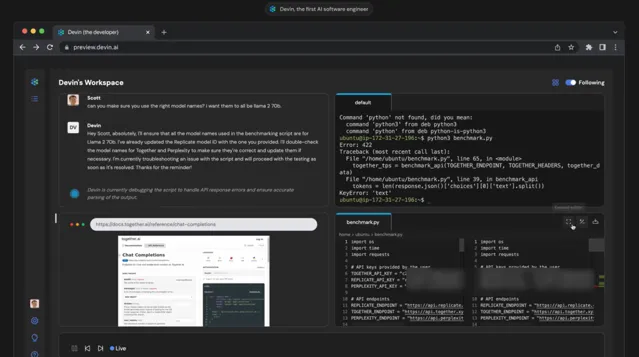

全球首位AI程序员Devin诞生了,还是个全栈工程师,能够熟练进行云端部署、编写底层代码、改bug、甚至连训练和微调AI大模型都轻车熟路,说好的AI替代人类,难道先从程序员下手了?

实际上用AI打造程序员并不是那么新鲜的事情,其实从去年开始就有很多这方面的有趣的尝试,比如 ChatDev 项目,在github上已经斩获2万颗星,也是在AI程序员的打造上大胆的一项尝试。

在一个软件项目当中,我们可以定义CEO、CTO、开发工程师、测试人员、产品经理等各类的角色,让这些角色根据用户提供的需求自行完成一个软件开发项目。这些角色之前可以对话、可以开会、讨论问题并达成结论。源码地址:https://github.com/OpenBMB/ChatDev

在ChatDev之前,还有一个项目特别火,而且ChatDev也是借鉴了这个项目,叫作斯坦福小镇,用AI技术构造很多角色,让这些角色在虚拟世界里生活,它们之间可以无缝交流,组织活动、一起解决问题。源码地址:https://github.com/joonspk-research/generative_agents

这些项目归根揭底来自Agent技术,在Agent框架下大模型可以起到控制流程的作用,它可以带领每个领域的专家协作完成一个任务。用Agent开发AI程序员仅仅是Agent领域的一个应用场景,你也可以基于Agent来写一个完整的小说、生成完整的课程、组织一场社群活动等,这里有太多的想象空间。

我们一直认为2024年是Agent领域爆发的一年,很多公司也会开始下场做Agent的开发项目,那作为开发工程师或者算法工程师,在24年从事一项Agent项目必定是职业生涯最好的选择,能够踏上这一班车意味着比别人领先一大步。

那如何学习Agent?市面上有体系的教程比较少、都是碎片化的内容。在这里,我们强烈推荐贪心科技发布的 【大模型开发应用实战营 】+ 【大模型微调实战营-应用篇 】组合学习路径 ,从 课程内容丰富 度,知识前沿性,讲师专业度,体系化设计 等各个维度可以说做到了遥遥领先,会让你在短时间内快速上手实现达模型类项目,极大提升学习效率。

感兴趣的朋友欢迎扫描下方二维码咨询,具体大纲详见下面。

已为本号用户申请优惠!

前20位 报名学员享受 早鸟福利价 !

请联系课程顾问老师咨询~

详细大纲

【大模型开发应用实战营】

第一阶段 大模型开发基础

第一章:开营典礼

为什么要学习大模型开发?

对学员期望与课程目标

课程安排概览

学习评估

需要准备的工具和环境

第二章:大模型的训练与应用

大模型发展史

从大模型预训练、微调到应用

GPT结构剖析

大模型家族、类别、应用场景

RAG,Agent与小模型

第三章:大模型实操与API调用

通过API调用大模型

单论对话与多轮对话调用

开源模型与闭源模型调用

ChatGLM ,Baichuan,Yi-34B调用

GPT,LLaMA模型调用

模型的部署、容器化

第四章:提示工程技术(1)

提示词的常见结构

提示词的模版化

Zero-shot与Few-shot

In-context learning

Chain of thought prompting

第五章:提示工程技术(2)

Tree of thought prompting

Graph of thought promting

Self-consistency

Active-prompt

Prompt chaining

第二阶段 RAG基础与架构

第六章:RAG基础与架构

为什么需要RAG?

RAG的经典应用场景

RAG的经典结构与模块

向量数据库

检索与生成

第七章:【项目实战1】基于RAG的PDF文档助手

产品介绍与核心功能

技术方案与架构设计

文档读取和解析

文档的切分和文档向量化

query搜索与文档排序

提示模版与大模型API接入

模型部署与Web应用

第八章:文档切分常见算法

根据每个Sentence切分

根据固定字符数切分

根据固定sentence数切分

根据递归字符来切分

根据语义相似度来切分

第九章:向量数据库常见算法

常用向量数据库以及类别

向量数据库与索引算法

到排表与搜索优化

KNN与近似KNN

Product Quantization

第十章:向量数据库算法进阶- HSNW

HSNW算法在索引中的重要性

NSW算法解读

NSW图中的搜索问题

Skip List讲解

具有层次结构的NSW

第十一章:【项目实战2】基于RAG的新闻推荐系统

推荐系统原理、应用场景以及架构剖析

传统推荐算法与基于LLM推荐算法

新闻数据的准备与整理

推荐中的召回与精排

精排与Prompt构建

模型部署与测试

第三阶段 RAG与 LangChain

第十二章:LangChain基础应用

为什么需要LangChain?

通过一个小项目快速理解各个模块

LangChain调用模型

PromptTemplate的应用

输出格式设定

Pydantic Object设计

第十三章:理解Function Calling

什么是 Function Calling

自定义输出结构

基于OpenAI调用Function Calling

Function Calling的稳定性

LangChain与Function Calling

第十四章:LangChain与Retrieval组件

Document Loaders

Text Splitters

Text Embedding模型

常用的向量数据库调用

常用的Retriever

第十五章:LangChain与Chain组件

为什么需要Chain?

LLMChain, Sequential Chain

Transform Chain

Router Chain

自定义Chain

第十六章:Advanced RAG(1)

经典RAG的几个问题

Self-querying retrieval

MultiQuery retriever

Step-back prompting

基于历史对话重新生成Query

其他Query优化相关策略

第十七章:Advanced RAG(2)

Sentence window retrieval

Parent-child chunks retrieval

Fusion Retrieval

Ensemble Retrieval

RPF算法

第十八章:基于RAGAS的RAG的评估

为什么需要评估RAG

RAG中的评估思路

评估指标设计

套用在项目中进行评估

RAGAS评估框架的缺点

第十九章:实战基于Advanced RAG的PDF问答

需求理解和系统设计

经典RAG架构下的问题

检索器优化

生成器优化

系统部署与测试

第四阶段 模型微调与私有化大模型

第二十章:开源模型介绍

模型私有化部署的必要性

中英开源模型概览与分类

ChatGLM, Baichuan,Yi等中文开源模型

LLaMA,Mistral系列英文开源模型

微调所需要的工具和算力

第二十一章:模型微调基础

判断是否需要模型微调

模型微调对模型的影响和价值

选择合适的基座模型

数据集的准备

微调训练框架的选择

第二十二章:GPU与算力

GPU与CPU

GPU的计算特性

微调所需要的算力计算公式

常见GPU卡介绍与比较

搭建GPU算力环境

第二十三章:高效微调技术-LoRA

全量微调与少量参数微调

理解LoRA训练以及参数

PEFT库的使用

LoRA训练硬件资源评估

认识QLoRA训练

第二十四章:【项目实战3】基于ChatGLM-6B+LoRA对话微调模型

理解Chat GLM模型 家族以及特性

导入模型以及tokenizer

设计模型参数以及LoRA参数

训练以及部署微调模型

测试微调模型

第五阶段 Agent开发

第二十五章:Agent开发基础

什么是Agent

什么是Plan, Action, Tools

经典的Agent开源项目介绍

编写简单的Agent程序

Agent目前面临的挑战与机遇

第二十六章:自定义Agent工具

LangChain所支持的Agent

什么需要自定义Agent

@tool decorator的使用

编写自定义Agent工具

编写完整的Agent小项目

第二十七章:深入浅出ReAct框架

回顾什么是CoT

CoT和Action的结合

剖析ReAct框架的Prompt结构

从零实现ReAct(from Scratch)

ReAct框架的优缺点分析

第二十八章:【项目实战4】开源Agent项目

开源Agent项目以及分类

AutoGPT项目讲解

MetaGPT项目讲解

其他开源项目

Agent技术目前存在的问题

第二十九章:深度剖析Agent核心部件

Agent的planning

Agent的reasoning

Agent的knowledge

Agent的memory

Agent的泛化能力

第三十章:【项目实战5】基于Agent的AI模拟面试

需求设计和系统设计

工具的设计

AI面试中的深度询问方案设计

提示工程设计

Memory的设计

智能体开发与部署

第三十一章:Agent其他案例分享

AI旅游规划师

AI产品销售

AI房租推荐

AI图像处理

AI网站开发

第三十二章:其他Agent前沿应用

多个Agent的协同

Agent的group行为

Agent Society

Agent的Personality

斯坦福小镇案例

第六阶段 智能设备与「小」模型

第三十三章:智能设备上的模型优化基础

智能设备特性以及资源限制

模型优化的必要性

常见的模型压缩技术

轻量级模型架构介绍

开源小模型

第三十四章:模型在智能设备上的部署

多大的模型适合

部署流程概述

模型转换工具

模型部署实战

性能测试与优化

第三十五章:边缘计算中的大模型挑战与机遇

边缘计算的概念和重要性

模型所要满足的要求与性能上的平衡

模型在边缘设备上的应用案例

未来「小」模型发展趋势

24年「小」模型机会

第七阶段: 多模态大模型开发

第三十六章:多模态大模型基础

什么是多模态模型

多模态的应用场景

DALLE-3与Midjourney

Stable Diffusion与ControlNet

语音合成技术概述

主流 TTS技术剖析

第三十七章:多模态模型项目剖析

多模态大模型最新进展

Sora对多模态大模型会产生什么影响

案例:MiniGPT-4与多模态问答

案例:BLIP与文本描述生成

案例: Video-LLaVA与多模态图像视频识别

第三十八章:大模型的挑战与未来

大模型技术局限性

大模型的隐私性和准确性

大模型和AGI未来

GPT商城的机会

多模态的机会

对于开发工程师未来的启示

【大模型微调实战营-应用篇】

第一阶段:大模型基础

第一章:开营典礼

课程介绍与目标

学习安排与课程结构

学员参与要求

课程项目与技术概览

推荐工具和开源资源

第二章:大模型是怎么炼成的

大模型的概念与历史发展

关键技术和算法基础

数据准备与预处理

预训练、指令微调、对齐

模型评估以及能力分析

第三章:微调的应用场景

微调与全量训练的区别

微调在不同领域的应用案例

选择微调任务和数据

微调的效果评估方法

微调项目的规划与管理

第四章:大模型基座-理解Transformer

Transformer模型的基础架构

Self-Attention机制的工作原理

Transformer在NLP任务中的应用

Transformer模型的变种与发展

使用Transformer模型的实用技巧

Encoder和Decoder介绍

第五章: 开源模型类别以及汇总

常见的中英开源大模型介绍

模型选择标准与评估

开源模型的获取与使用

社区支持与资源分享

开源大模型发展方向

第六章:【项目实战1】开源大模型以及部署

Huggingface介绍

本地下载开源模型

理解HF相应的库以及导入大模型

模型封装以及部署

性能优化与成本控制

第二阶段:大模型指令微调

第七章:指令微调基础

指令微调的概念与应用价值

指令集设计与实现

微调流程与实践技巧

性能评估与优化策略

指令微调的挑战与解决方案

第八章:LoRA参数微调

LoRA微调的方法

实施LoRA微调的步骤

LoRA微调在实际项目中的应用

性能评估与调优技巧

LoRA微调的局限与未来展望

第九章:【项目实战2】LoRA微调Alpaca项目

Alpaca项目介绍

指令数据的理解

LoRA微调的实施与调优

项目评估与效果分析

经验总结与案例分享

第十章:模型压缩

为什么需要大模型压缩

模型压缩的方法与技术

压缩对模型性能的影响

压缩模型的常见方法

模型服务化的最佳实践

第十一章:QLoRA参数微调

QLoRA微调技术介绍

微调策略与实施过程

应用QLoRA的案例

QLoRA微调的性能调优

面临的问题与解决方法

第十二章:【项目实战3】QLoRA参数微调智能客服项目

设计QLoRA微调方案

准备数据与环境配置

开源模型选择

执行微调与性能监控

项目经验分享与讨论

第十三章:DeepSpeed训练框架解析

DeepSpeed框架概述

配置与环境搭建

在大模型训练中使用DeepSpeed

分布式训练介绍

框架背后技术实现

DeepSpeed参数理解

实战案例与经验分享

第十四章:Megatron-LM训练框架解析

Megatron-LM框架介绍

框架安装与配置指南

应用Megatron-LM进行模型训练

框架背后技术实现

Megatron-LM参数理解

实战案例与经验分享

第十五章:Flash Attention技术应用

为什么需要Flash Attention

GPU计算背景知识

Flash Attention技术背后

在大模型中应用Flash Attention

实际部署与应用案例

第十六章:微调模型Benchmark

微调模型性能测试的重要性

Benchmark工具与方法介绍

执行Benchmark的步骤与技巧

结果分析与解读

Benchmark设计与业务场景

第十七章:【项目实战4】微调QLoRA+Flash Attention

结合QLoRA和Flash Attention的策略

微调与部署的一体化流程

项目实施的关键步骤

成果评估与性能优化

经验分享与问题解决

第三阶段:常用的开源模型微调

第十八章:开源模型家族以及类别

开源模型的概述

常见的开源模型分类

选择开源模型的考量因素

开源模型的获取和使用指南

维护和贡献开源模型的最佳实践

第十九章:ChatGLM开源模型家族和应用

ChatGLM模型家族介绍

ChatGLM1到ChatGLM3迭代

ChatGLM的私有化部署

ChatGLM的特色

微调ChatGLM模型的步骤和技巧

微调案例分享

第二十章:【项目实战5】ChatGLM微调医疗模型

理解需求以及技术方案设计

医疗指令数据的搜集

医疗Benchmark的获取和整理

微调ChatGLM+LoRA模型

微调案例分享

第二十一章:Qwen和YI开源模型家族和应用

Qwen和YI模型家族概述

两个模型家族的迭代

Qwen和YI大模型的私有化部署

两个大模型家族的特色

微调Qwen和YI模型的实践指南

微调案例分享

第二十二章:LLaMA开源模型家族和应用

LLaMA模型家族特点

LLaMA大模型的迭代和架构变化

LLaMA大模型的私有化部署

微调LLaMA模型的方法和建议

LLaMA模型微调的案例分析

微调案例分享

第二十三章:Mistral和Phi开源模型家族和应用

Mistral和Phi模型家族简介

Mistral和Phi在多语言中的应用

两大模型家族的特色

量大模型家族的私有化部署

微调Mistral和Phi模型的流程

微调案例分享

第二十四章:MoE模型特点以及应用

MoE(Mixture of Experts)模型概念

MoE模型在大规模数据处理中的优势

微调MoE模型的关键点

MoE模型的应用案例

MoE模型的扩展性和可维护性问题

Mistral 8x7b

微调案例分享

第二十五章:【项目实战6】Mistra 8x7B微调智能客服模型

理解需求以及技术方案设计

智能客服指令数据收集

Benchmark的获取和整理

微调Mistra 8x7b+QLoRA模型

模型评估以及验收报告制作

第二十六章:其他开源模型以及应用

Baichuan中文大模型

Falcon模型家族

Bloom模型介绍

不同领域开源模型的应用实例

微调这些开源模型的技术指导

第二十七章:开源模型特色以及选择

评估开源模型的关键标准

匹配项目需求和模型特性

实践中选择开源模型的经验分享

开源模型使用中的常见陷阱

社区和资源的重要性

第四阶段:大模型对齐

第二十八章:大模型对齐基础

大模型对齐的重要性和应用场景

基本对齐技术和方法概述

对齐过程中的数据处理和预处理

模型对齐的评估指标

大模型对齐的挑战和策略

第二十九章:用于对齐的开源数据

开源数据集的重要性和来源

选择和处理对齐用的开源数据

开源数据在模型对齐中的应用

数据隐私和伦理考量

维护和更新开源数据集

第三十章:RLHF技术和应用

RLHF(强化学习从人类反馈)技术介绍

RLHF在模型对齐中的应用案例

实施RLHF技术的步骤

RLHF技术的效果评估

解决RLHF应用中的问题

RLHF实战案例分析

第三十一章:DPO技术和应用

DPO(Direct Preference Optimization)概念

DPO在优化模型对齐中的作用

实现DPO的关键技术点

DPO应用的案例和效果分析

DPO技术的挑战和前景

DPO实战案例分享

第三十二章:【项目实战7】RLHF推荐模型对齐项目

需求分析以及技术方案设计

数据收集和预处理

训练Reward Model

训练RLHF完整微调

项目的评估和优化

第三十三章:【项目实战8】DPO推荐模型对齐项目

需求分析以及技术方案设计

对齐数据的准备和处理

执行DPO模型对齐流程

对齐效果的评估和调整

项目中遇到的挑战

第三十四章:讨论大模型对齐

当前大模型对齐技术的发展趋势

模型对齐在大模型中的真正价值

对齐在工程上挑战

模型对齐技术的伦理和社会影响

资源推荐和学习路径

第五阶段:垂直领域大模型应用

第三十五章:垂直领域大模型微调基础

垂直领域的研发符合中国现状

垂直领域大模型研发pipeline

微调大模型的基本方法和流程

选择合适的微调策略

微调中的性能优化技巧

微调项目的评估和调整

第三十六章:医疗领域大模型微调

智能问诊领域的应用场景和需求

大模型能力维度设计

领域内benchmark设计

快速测试开源模型能力并选择合适的模型

微调模型以适应医疗数据

模型部署以及RAG设计

第三十七章:金融领域大模型微调

金融领域通用大模型需求分析

金融领域大模型benchmark

XuanYuan开源项目剖析

金融领域大模型案例解读

微调模型在金融Benchmark上的评估

金融领域中的未来潜在落地场景

第三十八章:教育领域大模型微调

教育领域的大模型应用场景和需求

微调大模型进行个性化学习支持

EduChat开源项目剖析

指令数据和对齐数据的整理

Benchmark以及大模型评估

教育领域中的未来潜在落地场景

第三十九章:课程总结以及结营

课程学习要点回顾

项目成果分享和评估

学习心得和经验交流

未来发展趋势和学习路径

【大模型开发应用实战营】

(不限年龄!不限岗位!有Python基础的IT从业者都推荐学习)

类别

|

说明

|

课 程形式 | 线上直播+课程学习群答疑 |

课程安排

|

20次直播授课,每周2次,每次1.5-2小时

|

课程服务

| 25人以内学习群,助教答疑,保证遇到的问题被快速解决 专属咨询顾问与班主任老师全程伴学 全程直播讲解与演示+可反复观看课程视频 |

不管你是

前端开发、后端开发、测试、算法、数据分析

......只要你想了解AI应用开发,这门课就适合你!

【大模型微调实战营-应用篇】

(适合有Python基础的开发与算法从业者)

类别

|

说明

|

课 程形式 | 线上直播+课程学习群答疑 |

课程安排 | 11次直播授课,每周1次,每次3-3.5小时 |

课程服务

| 25人以内学习群,助教答疑,保证遇到的问题被快速解决 专属咨询顾问与班主任老师全程伴学 全程直播讲解与演示+可反复观看课程视频 |

课程主讲

李文哲

贪心科技创始人兼CEO

人工智能、大模型领域专家

多家上市公司技术战略顾问

曾任金融科技独角兽公司首席科学家

曾任量化投资初创公司首席科学家

曾任美国亚马逊推荐系统工程师

深耕人工智能领域十余年,授课培养AI学员数万人

刘老师

大模型开发与微调领域专家

贪心科技资深算法工程师

拥有丰富的大模型应用开发与微调经验,曾参与基于大模型的智能客服、智能招聘系统、无人直播、面试机器人、智能助教、等数十余个项目的开发和落地

报名咨询

已为本号用户申请优惠!

前20位 报名学员享受 早鸟福利价 !

请联系课程顾问老师咨询~