整理丨王轶群

责编丨唐小引

出品丨AI 科技大本营(ID:rgznai100)

在GitHub研究近900个开源AI工具,对了解人工智能生态系统有什么提升?一位人工智能畅销作家和计算机学家帮助全球开发者们做了大量数据分析。一起来看看这份新鲜出炉的开源AI生态报告。

近期,来自越南的作家和计算机科学家、【设计机器学习系统】作者Chip Huyen(奇普·惠恩)在个人网页发文【我从900个最流行的开源AI工具中学到了什么】,对开源AI工具进行了观察和总结。

条件限定在Star大于500的仓库,她通过GitHub搜索LLM、GPT和Generative AI等关键词,结果分别为590个、531个和38个。数小时后,她找到了896个仓库,最终获得了845个软件仓库,其中51个是教程和汇总列表,794个是软件项目。

Chip Huyen表示:「这个过程是痛苦却十分有益的。在观察和总结的过程中,我 更好地了解人们正在做什么、开源社区的协作程度如何,以及中国的开源生态系统与西方生态系统的差异。 」

开源AI工具分层解析

新AI堆栈

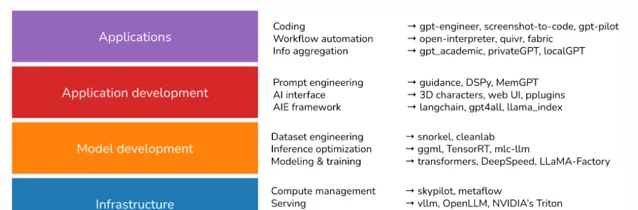

Chip Huyen认为AI堆栈由4层组成:基础设施、模型开发、应用程序开发和应用程序。

基础设施层 :AI堆栈的底层是基础设施,其中包括模型部署(vllm、NVIDIA 的 Triton)、计算管理(skypilot)、向量搜索数据库(faiss、milvus、qdrant、lancedb)等。

模型开发层 :提供用于开发模型的工具,包括建模和训练架构(Transformers、pytorch、DeepSpeed)、推理优化(ggml、OpenAI/triton)、数据集、评估等。

应用开发层 :也被称为人工智能层。有了现成的模型,任何人都可以在其上开发应用程序,这是过去两年内运行最多的层,且仍在快速发展。包括提示工程、人机界面、Agent、AIE框架等。

应用层 :有许多开源应用构建在现有模型之上。最流行的应用程序类型是编码、工作流程自动化、聊天机器人、信息聚合等。

除了这 4 层之外,Chip Huyen认为还有另一个类别,即 模型仓库层 。模型仓库层由公司和研究人员创建,用于共享与其模型相关的代码。此类别中的存储库示例包括CompVis/stable-diffusion、openai/whisper和facebookresearch/llama。

通过绘制每层内仓库的累计数,Chip Huyen总结出2023年AI堆栈的变化趋势。

2023年 应用和应用开发层增长迅速 ,且应用增长最快。

2023年 基础设施层变化不大 ,仅有微小增长,与其他层的增长水平相差甚远。

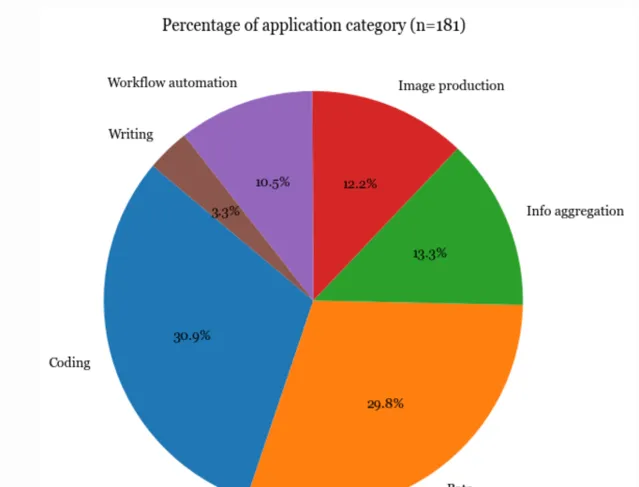

最流行的应用程序类型是编码、机器人(如角色扮演、WhatsApp 机器人、Slack 机器人)和信息集成。

人工智能工程

在应用领域, 提示工程、人机界面、推理优化最热门 。2023年是人工智能工程年,这一年AI工程发生了爆发式的增长。

Chip Huyen把人工智能工程分为提示工程、人机界面、Agent和AI工程(AIE)框架。

提示工程 不仅是提示,还涵盖受约束采样(结构化输出)、长期内存管理、提示测试和评估等。

人机界面 是为用户提供与AI应用程序交互的界面,是令Chip Huyen最为兴奋的类别。其中越来越受欢迎的界面是:网络和桌面应用程序;浏览器插件;承载于Slack、Discord、微信、WhatsApp等聊天应用程序的机器人;开发人员能够将AI应用嵌入到 VSCode、Shopify 和 Microsoft Offices 等应用程序中的插件。插件方法对于可以使用工具完成复杂任务的人工智能应用程序来说很常见(Agents)。

AIE框架 是所有开发AI应用程序的平台总称。其中许多都是围绕 RAG 构建的,但许多还提供其他工具,例如监控、评估等。

Agent 是一个特殊的类别,因为许多Agent只是复杂的提示工程,由潜在受限的生成(如只输出预设动作的模型)和插件(如让Agent使用工具)集成。

模型开发

在 ChatGPT 之前,AI堆栈主要由模型开发主导。2023 年模型开发的最大增长来自于对推理优化、评估和参数高效微调(归属于建模和训练)的日益增加的影响力。

推理优化一直很重要,但当今基础模型的规模使其对延迟和成本至关重要。优化的核心方法保持不变(量化、低秩分解、裁剪、蒸馏),但特别针对Transformer架构和新一代硬件开发了许多新技术。例如,在 2020 年,16 位量化被认为是最先进的。今天,我们看到了2 位量化,甚至低于 2 位。

同样,评估一直都是必不可少的,但由于当今许多人将模型视为黑匣子,评估变得更加重要。出现了许多新的评估基准和评估方法,例如比较评估(参见Chatbot Arena)和AI-as-a-judge。

基础设施

基础设施涉及数据管理、计算、服务和监控的工具,以及其他平台工作。尽管生成式人工智能带来了所有变化,但开源人工智能基础设施层或多或少保持不变。这也可能是因为基础设施产品通常不是开源的。

这一层的最新类别是向量数据库,包括 Qdrant、Pinecone 和 LanceDB 等公司。然而,许多人认为这根本不应该成为一个类别。向量搜索已经存在很长时间了。DataStax 和 Redis 等现有数据库公司不再仅仅为向量搜索构建新数据库,而是将向量搜索引入已有数据库。

开源AI开发者生态画像

开源人工智能开发者分布

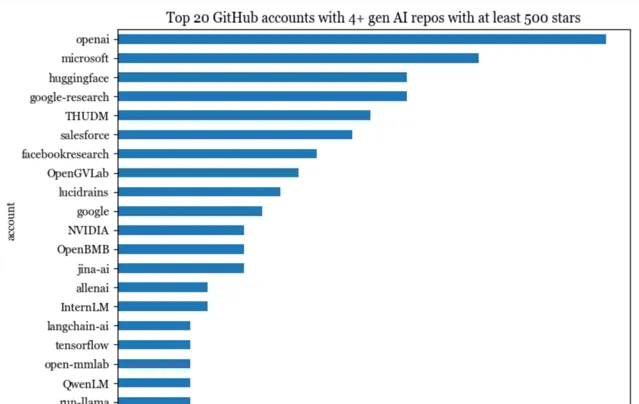

开源软件呈长尾分布,少数账户掌握着大量仓库。

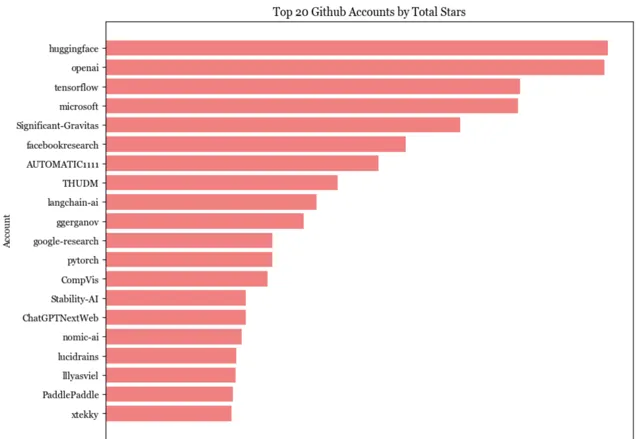

845个存储库掌管在 594 个特定的GitHub帐户上。有20个帐户至少有4个仓库。 前20的账户共掌管着195个仓库,占所有统计中的23% 。这195个仓库总共获得了165万颗star。

Github上的帐户可以是组织,也可以是个人。95%的前20帐户是组织。其中,3个属于谷歌:google-research, google, tensorflow。

这前20名的账户中唯一的个人账户是 lucidrains。Star数最多的前 20 个账户

中(仅算 gen AI 仓库),个人账户有 4 个:

lucidrains (Phil Wang):能够以惊人的速度实现最先进的模型。

格尔加诺夫(Georgi Gerganov):物理背景的优化大神。

Illyasviel(张吕敏):Foocus 和 ControlNet 的创建者,目前是斯坦福大学博士。

xtekky:创建 gpt4free 的全栈开发人员。

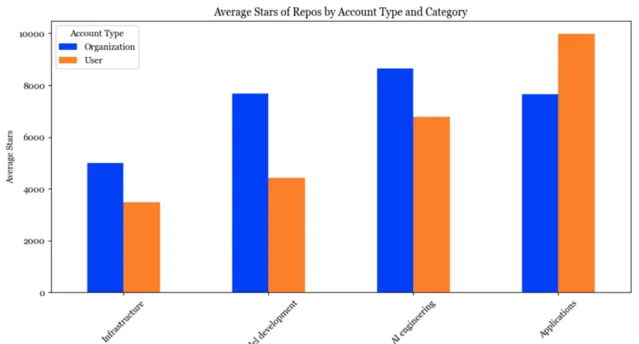

不出所料,在堆栈的地位越低,个人构建起来就越难。基础设施层的软件最不可能由个人账户启动和掌管,而超过一半的应用程序由个人掌管。

通常来说,个人发起的应用程序比组织发起的应用程序获得更多Star。Sam Altman等人推测我们将看到许多非常有价值的个人公司,Chip Huyen认为这是有可能的。

百万次的提交

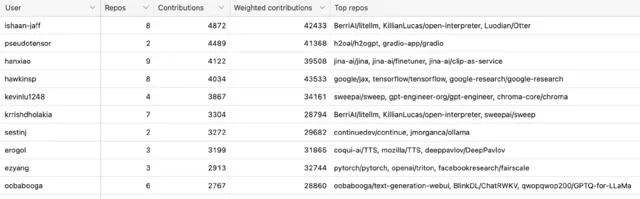

超过2万名开发人员为这845个仓库做出了贡献,总计100万次提交的贡献!

其中,最活跃的50名开发者的提交次数超过10万次,平均每人提交次数超过2000 次。

不断发展的中国开源生态系统

GitHub 上有很多针对中国受众的热门人工智能仓库,其介绍都是用中文编写的。有针对中文或中文+英文开发的模型的仓库,例如Qwen、ChatGLM3、Chinese-LLaMA。

虽然在美国许多研究实验室已经放弃了语言模型的 RNN 架构,但基于 RNN 的模型系列RWKV仍然很受欢迎。

还有一些人工智能工程工具提供了将人工智能模型集成到微信、QQ、钉钉等中国流行产品中的方式。许多流行的提示工程工具也有中文范式。

GitHub 上排名前 20 的账户中,有 6 个来自中国:

THUDM:清华大学知识工程研究室和数据挖掘小组

OpenGVLab:上海人工智能实验室通用视觉团队

OpenBMB:开源社区OpenBMB,由面壁智能联合清华大学 NLP 实验室共同创立

InternLM:来自上海AI实验室。

OpenMMLab:来自香港中文大学。

QwenLM:阿里巴巴的人工智能实验室,该实验室发布了Qwen模型系列。

AI项目的现象与偏好

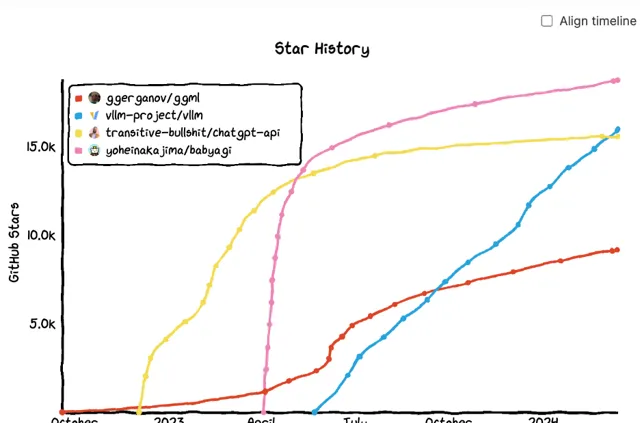

短命的项目:诞生迅速,消亡也迅速

Chip Huyen在2023年看到的一种现象是,许多仓库很快获得大量关注,然后又很快消失。这样的趋势被她的一些朋友称之为「炒作曲线」。在这 845 个拥有至少500个GitHub Star的仓库中,有158 个仓库 (18.8%) 在过去24小时内没有获得任何新star,37 个存储库 (4.5%) 在上周没有获得任何新star。

下方的示例图,是两个此类仓库与两个更持久的软件的增长曲线对比。尽管这里显示的这两个案例已不再使用,但Chip Huyen认为它们具备向社区展示可能性的价值,且作者能够如此快速地构建产品是很cool的。

Chip最喜欢的想法

Chip Huyen在文章的结尾出列出了自己感兴趣的想法:

社区正在开发许多很酷的想法,这是一些我最喜欢的:

批量推理优化:FlexGen、llama.cpp

使用Medusa、LookaheadDecoding等技术实现更快的解码器

模型融合:mergekit

受约束采样:轮廓、指导、SGLang

专注解决一个问题的项目也很有价值,例如einops和safetensors

结论

Chip Huyen在分析中囊括了845 个仓库,但她实际上浏览了数千个仓库。她认为,这份分析有助于全面了解看似势不可挡的人工智能生态系统。读者们如果有补充,Chip Huyen会将之添加到列表中。

Chip Huyen

Chip Huyen,一位来自越南的作家和计算机科学家,实时机器学习平台Claypot AI的联合创始人,MLOps Discord的维护者,曾在NVIDIA、 Snorkel AI和 Netflix构建过机器学习工具,是GitHub的活跃用户。

毕业于斯坦福大学(Stanford University),获得计算机科学学士和硕士学位。在斯坦福大学创建并教授CS 329S:机器学习系统设计课程,并著有亚马逊人工智能领域畅销书【设计机器学习系统】。

长期从事人工智能研究,是机器学习领域专家级人物,在研究过程中,主张机器学习要面向实践,面向实际,立志解决当前问题,AI必须要有商业驱动,方能足够长远的发展。

相关 链接 :

【What I learned from looking at 900 most popular open source AI tools】

http://t.cn/A6TPU1pM

4 月 25 ~ 26 日,由 CSDN 和高端 IT 咨询和教育平台 Boolan 联合主办的「 全球机器学习技术大会 」将在上海环球港凯悦酒店举行,特邀近 50 位技术领袖和行业应用专家,与 1000+ 来自电商、金融、汽车、智能制造、通信、工业互联网、医疗、教育等众多行业的精英参会听众,共同探讨人工智能领域的前沿发展和行业最佳实践。 欢迎所有开发者朋友访问官网 http://ml-summit.org、点击「阅读原文」或扫码 进一步了解详情。