整理 | 王軼群

出品丨AI 科技大本營(ID:rgznai100)

如果使用者與 ChatGPT 的對話超出了上下文視窗,其效能將急劇下降。目前,增加上下文長度已成為科技公司改進模型並獲得有利競爭的主要努力方向之一。

最近,谷歌釋出了新的一篇論文介紹了一項新技術,使大語言模型能夠處理無限長度的上下文。新論文聲稱可賦予大型語言模型(LLM)處理無限長度文本的能力。該論文介紹了無限註意力(Infini-attention),這是一種以擴充套件「上下文視窗」的方式配置語言模型的技術,同時保持記憶體和計算需求不變。

論文地址 : https://arxiv.org/abs/2404.07143

谷歌研究團隊報告的實驗表明,使用無限註意力的模型可以在超過一百萬個tokens的情況下保持其品質,而無需額外的記憶體。理論上,同樣的趨勢可以持續到更大的長度。

無限註意力

Transformer 是LLM中使用的深度學習架構,其記憶體占用和計算時間具有「二次復雜度」。這意味著變壓器處理數據所需的記憶體量和時間隨著輸入數據的大小呈指數增長。例如,如果將輸入大小從 1,000 個tokens擴充套件到 2,000 個tokens,則處理輸入所需的記憶體和計算時間不僅會增加一倍,還會增加四倍。

這種二次關系是由於 Transformer 中的自註意力機制造成的,它將輸入序列中的每個元素與其他每個元素進行比較。

在過去幾年中,研究人員開發了不同的技術來降低延長LLM上下文長度的成本。該論文將無限註意力描述為「長期壓縮記憶和局部因果註意力,用於有效地建模長期和短期上下文依賴關系」。

無限註意力架構

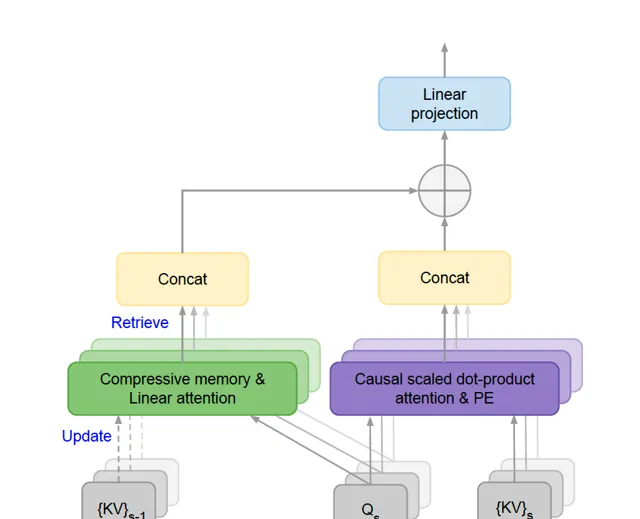

這意味著Infini-attention在變壓器塊中保留了經典的註意力機制,並添加了「壓縮記憶體」模組來處理擴充套件輸入。一旦輸入超出其上下文長度,模型就會將舊的註意力狀態儲存在壓縮記憶元件中,該元件會維護恒定數量的記憶參數以提高計算效率。為了計算最終輸出,Infini-attention 聚合了壓縮記憶體和本地註意力上下文。

研究人員表示:「對 Transformer 註意力層進行如此微妙但關鍵的修改,可以透過持續的預訓練和微調,將現有的LLM自然擴充套件到無限長度的上下文。」

無限註意力架構的實際表現

研究人員在非常長的輸入序列上測試 LLM 的基準測試中測試了 Infini-attention Transformer。在長上下文語言建模中,Infini-attention 保持較低的困惑度分數(模型一致性的衡量標準),同時需要 114 倍的記憶體,從而優於其他長上下文 Transformer 模型。

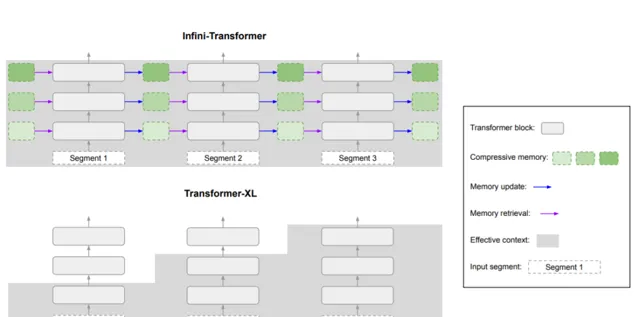

Infini-Transformer(上方)具有完整的上下文歷史記錄,而 Transformer-XL (下方)丟棄舊上下文,因為它僅緩存最後一段的 KV 狀態

在「金鑰檢索」測試中,Infini-attention 能夠返回插入最多一百萬個tokens的長文本中的隨機數。它在總結最多 500,000 個標記的文本任務方面優於其他長上下文技術。

論文稱,測試是在具有 10 億和 80 億參數的 LLM 上進行的。谷歌沒有釋出模型或程式碼,因此其他研究人員無法驗證結果。然而,報告的結果與Gemini報告的效能相似,Gemini 的上下文長度為數百萬個tokens。

長上下文大語言模型的套用

長上下文大語言模型已成為前沿人工智慧實驗室之間研究和競爭的重要領域。Anthropic 的Claude 3支持多達 200,000 個tokens,而 OpenAI 的GPT-4具有 128,000 個tokens的上下文視窗。

具有無限上下文的大語言模型的突出優勢之一是建立自訂應用程式。目前,為特定套用客製LLM需要微調或檢索增強生成(RAG)等技術。雖然這些技術非常有用,但它們需要具有挑戰性的工程工作。

理論上,具有無限上下文的LLM可以讓使用者將所有文件插入提示中,並讓模型為每個查詢選擇最相關的部份。它還可以讓使用者透過提供一長串範例來自訂模型,以提高其在特定任務上的效能,而無需對其進行微調。

然而,這並不意味著無限上下文將取代其他技術。它將降低應用程式的進入門檻,使開發人員和企業能夠快速為其應用程式建立工作原型,而無需進行大量的工程工作。企業需最佳化其LLM的研發生產系統,以降低成本並提高速度和準確性。

參考連結:

https://venturebeat.com/ai/googles-new-technique-gives-llms-infinite-context/

4 月 25 ~ 26 日,由 CSDN 和高端 IT 咨詢和教育平台 Boolan 聯合主辦的「 全球機器學習技術大會 」將在上海環球港凱悅酒店舉行,特邀近 50 位技術領袖和行業套用專家,與 1000+ 來自電商、金融、汽車、智慧制造、通訊、工業互聯網、醫療、教育等眾多行業的精英參會聽眾,共同探討人工智慧領域的前沿發展和行業最佳實踐。 歡迎所有開發者朋友存取官網 http://ml-summit.org、點選「閱讀原文」 預約領取大會 PPT