项目简介

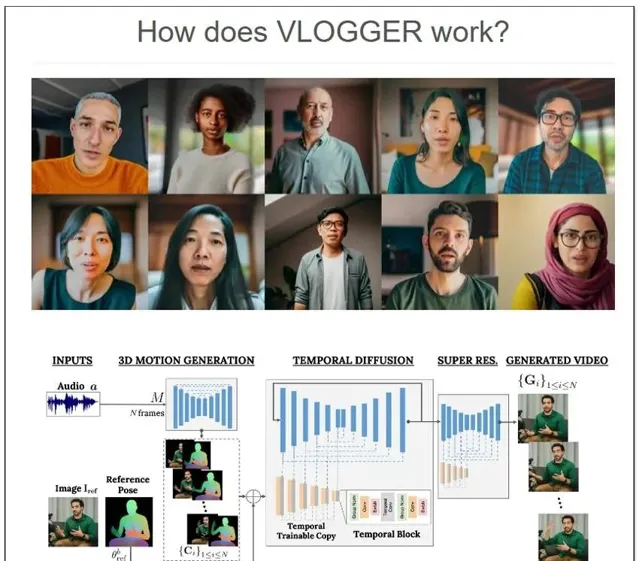

Google的研究人员开发了一种新的人工智能系统,能够仅从一张静态照片出发,生成人物讲话、手势和移动的逼真视频。这项技术,名为VLOGGER,依赖于先进的机器学习模型来合成惊人逼真的视频画面,这开启了一系列潜在应用的可能性,同时也引发了关于深度伪造和错误信息的担忧。

扫码加入交流群

获得更多技术支持和交流

(请注明自己的职业)

在一篇题为「VLOGGER: 用于生成化身的多模态扩散」的研究论文中描述了这个AI模型。该模型可以取一个人的照片和一个音频剪辑作为输入,然后输出一个与音频匹配的视频,展现那个人说话的样子并做出相应的面部表情、头部移动和手势。这些视频并非完美,但在动画化静态图像的能力上代表了一个重大飞跃。

合成说话头像的突破

这项研究是在Google Research的Enric Corona带领下进行的,研究者们利用了一种叫做扩散模型的机器学习模型来实现这一创新成果。最近,扩散模型在从文本描述生成高度逼真图像方面表现出了显著的性能。通过将它们扩展到视频领域,并在一个庞大的新数据集上进行训练,团队能够创建一个AI系统,以一种非常令人信服的方式使照片栩栩如生。

「与之前的工作相比,我们的方法不需要对每个人进行训练,不依赖于面部检测和裁剪,生成完整的图像(不仅仅是脸部或嘴唇),并考虑了一系列广泛的场景(例如,可见的躯干或不同的主体身份),这些都是正确合成交流中的人类所必需的,」作者写道。

一个关键的使能因素是创建了一个名为MENTOR的庞大新数据集,包含超过800,000个不同身份和2,200小时的视频——比之前可用的数据量大了一个数量级。这使得VLOGGER能够学习生成各种不同种族、年龄、服装、姿态和环境的人物视频。

论文链接

https://enriccorona.github.io/vlogger/paper.pdf

关注「 开源AI项目落地 」公众号