從2月份OpenAI第一次發出Sora的視訊,到現在已經10個月了,Sora終於上線。

但是,Sora經歷了這麽久的沈澱,效果也不能說是完美。

3月份北大團隊提出要復刻Sora,啟動了一個叫Open-Sora的計劃。

在當時還覺得就是他們團隊隨便玩玩。

但是沒想到, 他們堅持了下來,而且真的拿出成果給大家看了。

從3月份到現在,一直在不斷地叠代更新。

總有一天,開源跟閉源的差距會越來越小。

目前版本我認為,已經算是開源裏不錯的AI計畫了,就這個更新速度來看的話,即將到來的版本可能還會有驚喜。

今天給大家介紹的是1.3版本。

掃碼加入AI交流群

獲得更多技術支持和交流

(請註明自己的職業)

DEMO

官方給了一段黑神話悟空的創意視訊DEMO,用的是圖生視訊功能。

計畫亮點

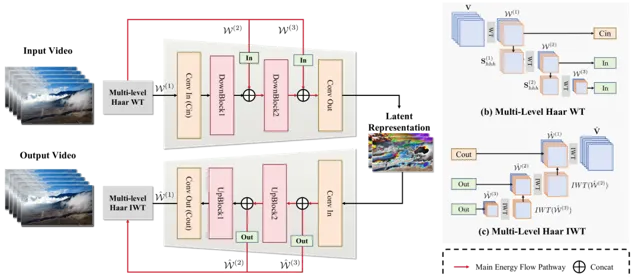

1、高效能 CausalVideoVAE,訓練成本低

高壓縮比,能將視訊壓縮至原來的 1/256(4×8×8),在保證優秀效能的同時,大大降低了訓練成本。

Causal 摺積支持影像和視訊的同時推理,且僅需 1 個節點即可完成訓練。

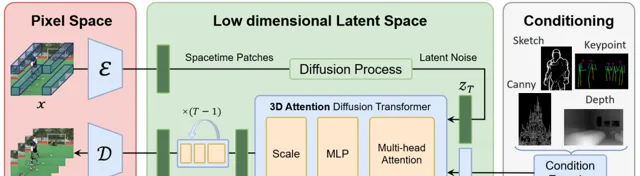

2、基於 3D 註意力的視訊擴散模型,時空特征聯合學習

采用全新的稀疏註意力架構,替代了傳統的 2+1D 模型。

3D 註意力能夠更好地捕捉空間和時間的聯合特征,提升了模型對時空特性的理解能力。

技術特點

1.多元件架構:

Wavelet-Flow Variational Autoencoder (WF-VAE):透過多級小波變換在頻率域獲取多尺度特征,並將其註入到摺積網路中,以減少記憶體使用並提高訓練速度。

Joint Image-Video Skiparse Denoiser:將2+1D視訊生成去噪器改為3D全註意力結構,增強了模型對世界的理解能力,包括物體運動、相機移動、物理和人類行為。

Condition Controllers:設計了幀級影像條件控制器,以支持包括影像到視訊、視訊轉換和視訊延續在內的多種任務。

2.高效訓練和推理策略:

Min-Max Token Strategy:透過聚合不同分辨率和時長的數據,實作高效的NPU/GPU計算,並最大化數據的有效使用。

Adaptive Gradient Clipping Strategy:提出自適應梯度裁剪策略,基於梯度範數檢測異常數據,防止異常值扭曲模型的梯度方向。

Prompt Refinement Strategy:開發了提示細化器,使模型能夠合理擴充套件輸入提示,同時遵循語意,增強視訊運動的穩定性並豐富細節。

3.多維數據管理流程:

Multi-dimensional Data Processor:包括檢測跳躍剪輯、剪輯視訊、過濾快慢動作、裁剪邊緣字幕、過濾審美分數、評估視訊技術品質以及註釋字幕。

LPIPS-Based Jump Cuts Detection:基於學習感知影像修補程式相似性(LPIPS)實作視訊剪輯檢測方法,防止快速運動鏡頭的錯誤分割。

4.條件註入模型: 包括深度圖、姿態圖、草圖、文本等控制條件,實作精確的單幀操作。

5.視訊生成模型的框架: 能夠處理包括文本提示、多影像和結構控制訊號(如邊緣檢測、深度、草圖等)在內的多種條件查詢。

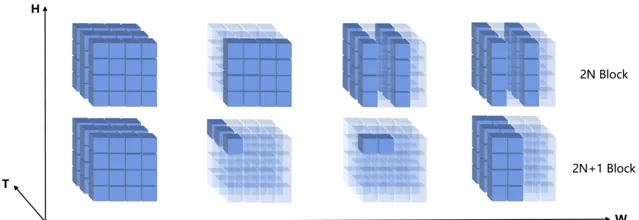

6.Skiparse Attention: 提出了一種新的稀疏註意力機制,減少了計算復雜度,同時保持了對物理世界的復雜互動的建模能力。

7.結構條件控制器: 提出了一種新的結構條件控制器,以高效地將結構訊號(如Canny邊緣、深度圖、草圖)整合到基礎模型中,實作可控生成。

計畫連結

https://github.com/PKU-YuanGroup/Open-Sora-Plan

論文連結

https://arxiv.org/abs/2412.00131

關註「 開源AI計畫落地 」公眾號

與AI時代更靠近一點

關註「 AGI光年 」公眾號

獲取每日最新資訊

關註「 向量光年 」公眾號

加速全行業向AI轉變