GPT-4o 中的「o」代表「omni」——指的是 GPT-4o 的 多模態 。

作者 | 王啟隆

出品丨AI 科技大本營(ID:rgznai100)

在我們的深夜、太平洋時間的上午 10 點,OpenAI 召開春季釋出會,推出了一款名為 GPT-4o 的「旗艦級」生成式人工智慧模型,並將在未來幾周內在公司面向開發者和消費者的產品中叠代推出。 該模型將向免費客戶開放,這意味著任何人都可以透過 ChatGPT 存取 OpenAI 最先進的技術 。

GPT-4o 中的「 o 」代表「 omn i 」,指的是 GPT-4o 的 多模態 。

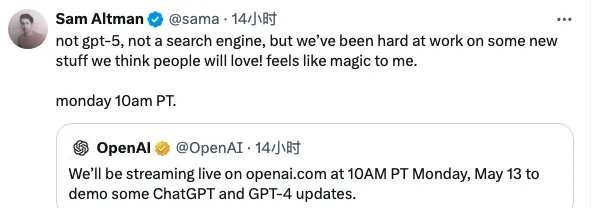

會前,OpenAI 執行長( CEO )山姆·阿特曼( Sam Altman )神秘兮兮地發了一條推文,給整個釋出會奠定了基調:

「她」 (Her)。

此刻應該沒有人想得到,OpenAI 真的把 ChatGPT 變成了一個「女機器人」。

釋出會全程回顧:她來了

釋出會的第一個「她」——OpenAI 技術長(CTO)Muri Murati 亮相直播間,迅速帶來了關於 GPT-4o 以及 ChatGPT 最新特性的一系列介紹。

ChatGPT 桌面版及使用者介面最佳化

會議首先介紹了 ChatGPT 桌面版的釋出,旨在透過簡化使用者介面,提升產品的可用性和存取便捷性。新設計強調簡潔直觀,確保使用者能自然流暢地與 ChatGPT 互動,無論何時何地。

由於重頭戲是 GPT-4o,這裏就不多介紹桌面版 ChatGPT 有多酷了,我們等到後面第三部份講 OpenAI 官方部落格的時候再進一步深入。

GPT-4o 模型釋出

Muri Murati 緊接著就把 重點轉向了 GPT-4o 模型 的釋出,這是對現有技術的一次重大飛躍,首次 將 GPT-4 級別的智慧普及到所有使用者 ,包括免費使用者 。GPT-4o 不僅在文本處理方面表現出色,還在影像和音訊處理能力上實作了顯著增強,標誌著人機互動進入了一個更為自然和便捷的新時代。

Murati 接著講到,OpenAI 的 核心使命之一是普及尖端 AI 工具,透過減少使用障礙,如無需註冊即可使用 ChatGPT,以及推出桌面應用程式,讓技術觸手可及。這些努力是為了直觀展現技術潛力,促進廣泛的認知融合。 GPT-4o 的釋出標誌著人機互動方式的革新,它 能夠處理對話的微妙細節,如自然語言理解、環境噪音過濾及多聲部對話 ,這些都是傳統上對 AI 模型的巨大挑戰。 透過內建轉錄、智慧分析和文本轉語音等功能,GPT-4o 大大降低了互動延遲,提升了沈浸式體驗。

以往僅對付費使用者開放的一些高級功能,現在得益於 GPT-4o 的效率提升,將免費提供給所有使用者。 這意味著更多的使用者可以享受客製化體驗、視覺上傳功能、記憶和瀏覽功能,以及高級數據分析服務。

Murati 宣布, ChatGPT 的使用者已經達到了 1 億 。

ChatGPT 新增的 視覺支持功能允許使用者上傳圖片和文件,記憶功能確保對話連貫,瀏覽功能實作即時資訊搜尋,數據分析則處理圖表和數據資訊,提供即時答案,這些都極大增強了 ChatGPT 的實用性。此外, GPT 4.0 在 50 種語言上的表現得到了顯著的速度和品質提升,這對於全球使用者來說是一個重要的進步,確保了服務的廣泛普及。

場面話結束了,接下來將是見證「

魔法

」的時刻。

會前,Altman 曾經這麽說過:就像魔法一樣。

科幻片上映—— GPT-4o 超強現場演示

Murati 邀請了兩位 OpenAI 的研究主管上台,他們是 Mark Chen(圖左,推特:@markchen90)和 Barrett Zoph(圖右推特:@barret_zoph)。

未來教學人機互動史的時候,這兩個人的名字可能會成為考試的一道問題。

無延遲語音即時對話,還能打斷發言

Muri Murati 緊接著就把重點轉向了 GPT-4o 模型 的釋出,這是對現有技術的一次重大飛躍,首次 將 GPT-4 級別的智慧普及到所有使用者 ,包括免費使用者 。GPT-4o 不僅在文本處理方面表現出色,還在影像和音訊處理能力上實作了顯著增強,標誌著人機互動進入了一個更為自然和便捷的新時代。

本次展示聚焦於 ChatGPT 套用的即時對話語音功能,透過現場演示,展示了使用者與 AI 之間流暢無阻的互動體驗。Mark Chen 透過手機上的應用程式,啟用了 GPT-4o 的音訊功能,與 AI 進行了即時對話,並體驗了其即時響應與情緒感知能力。

Mark 告訴聊天機器人,他對這次演示很緊張,請 ChatGPT 給他一些建議,幫助他冷靜下來。然後,Mark 對著自己的手機大喘氣模擬了一下深呼吸,ChatGPT 調侃了回去:「Mark,你又不是吸塵器!」

Mark 特別指出了新功能與舊語音模式的主要區別: 使用者現在可以直接打斷模型,無需等待模型完成發言即可插話,大大提高了對話的自然流暢度 。此外,新模型消除了延遲現象,反應迅速,不再有尷尬的等待時間。更重要的是,它能夠感知使用者的情緒狀態,根據使用者的語氣和節奏調整交流方式,展現出更人性化的互動 體驗。

隨後,ChatGPT 被要求用各式各樣的腔調來講述一個故事, 在這段演示裏,Mark 和 Barret 反復地打斷 ChatGPT,並重新要求她換個腔調講故事 。她能夠根據使用者要求調整語音的語調和情感色彩,從平靜敘述到充滿戲劇性的講述,再到以機器人的聲線講述故事,甚至透過歌唱來結束故事,極大地豐富了交流的互動性和趣味性:

GPT-4o 加持的 ChatGPT 正在變得越來越「情緒化」。 情緒感知是此次更新的一大亮點,ChatGPT 不僅能夠辨識使用者的情緒,還能在對話中適時提出建議 。這種能力讓 AI 能夠更貼近使用者需求,提供更具針對性的幫助和支持。這與 Inflection.ai 開發的人工智慧套用 Pi 非常相似,但 Inflection.ai 之前就已經被微軟收購了(微軟又和 OpenAI 有著難舍難分的關系)。

視覺 + 推理

GPT-4o 還改進了 ChatGPT 的視覺能力。ChatGPT 現在能「看見」事物並進行推理。透過手機網路攝影機,她看到了一道寫在 紙 上的數學題,並幫助兩位演示者解題:

透過一個線性方程式的例項(3x + 1 = 4),對話深入到具體的數學問題解決策略中。

然後,Barret 在紙上又寫了「我愛 ChatGPT」(I love ChatGPT)的字樣,她的反應也是相當精彩:

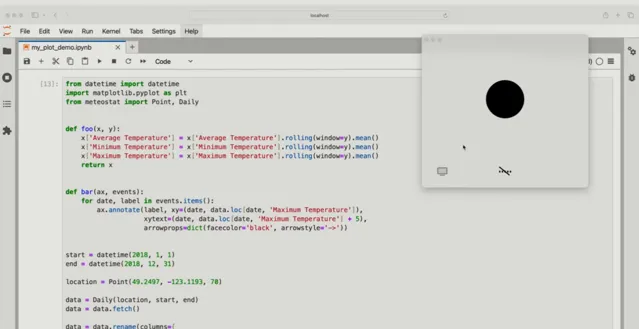

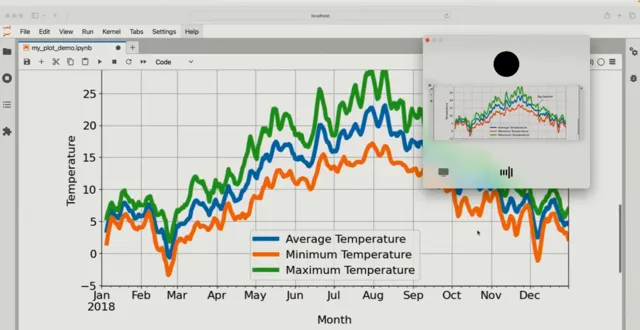

接下來,她又被要求解釋一些電腦程式碼,順帶展示了最新的 ChatGPT 客戶端:

Barret 分享的程式碼旨在處理特定地點及時間段的天氣數據,透過移動平均法平滑溫度數據,並視覺化全年氣溫變化。在程式碼執行後,透過啟用 ChatGPT 的視覺功能,雙方共享了圖表內容。

圖表展示了 2018 年全年溫度變化,特別指出了 9 月末的大雨事件,以及 7 月和 8 月的最高溫區間(約 25 到 40 攝氏度)。這一環節不僅驗證了程式碼的正確執行,也突顯了 ChatGPT 處理數據、生成圖表和分析結果的能力。

能言善辯、感知情緒

Mark 之後演示了 ChatGPT 的即時轉譯能力:每當他說英語的時候,ChatGPT 要轉譯成義大利語並告訴旁邊的 Murati;而 Murati 用義大利語回應時,ChatGPT 又得轉譯成英語給 Mark 做解釋:

透過英語與義大利語的互譯,展示了跨語言交流的便捷性,強化了其作為一個溝通橋梁的角色。

在另一個互動環節中,透過一張自拍照,ChatGPT 被要求根據 Barret 的面部表情推斷情緒,成功辨識出他愉快和興奮的情緒狀態。

釋出會宣告尾聲,三位演示者表示 GPT-4o 未來即將向更廣泛的使用者群體開放新功能,並對 OpenAI 團隊和 NVIDIA 團隊 的支持表達了感謝。

會後「眾生相」:像推土機一樣摧毀行業!

AI 春晚的影響力不可小覷,整個圈內都陷入了激動的狀態,只可憐谷歌明天的 I/O 大會了。在眾多反應裏,幾位 AI 圈的名人也先後出來展示了自己的看法:

Andrej Karpathy 曾擔任特斯拉的人工智慧和自動駕駛視覺總監,負責領導 Autopilot 團隊,這是從 2017 年開始的,當時埃隆·馬斯克從 OpenAI 將他挖角至特斯拉。在此之前,他還是 OpenAI 的創始成員 之一,擁有在史丹佛大學的學術背景,並且是「AI 教母」李飛飛的學生。

這位大神第一時間分享了自己的 reaction:

OpenAI 正在釋出一個整合了文本-音訊-視覺的模型,該模型在一個單一的神經網路中處理全部三種模態。這樣一來,只要你要求,它就能夠作為特殊情況下的一個補充功能,實作 即時語音轉譯 。

引得馬斯克在底下評價:「這是個更好的表達方式」。

輝達研究科學家 Jim Fan 是 AI 圈的「網紅」,他一向走在 X 的資訊前沿,這次同樣也是發表了相當深度的解析:

現在你的動態可能滿是諸如「不可思議的突破、【HER】、本次釋出會你錯過的十大特性、王者再臨」這樣的字眼。 不妨靜下心來,跟著我的節奏一步步剖析。

高品質的數據至少可以從兩個來源獲得:

1. 來自 YouTube、播客、電視劇、電影等自然發生的對話 。 Whisper 可以被訓練來辨識對話中的發言者輪換或分離重疊的語音以進行自動標註。

2. 合成數據 。 使用最強大的模型執行慢速的三階段管道: speech1->text1(ASR),text1->text2(LLM),text2->speech2(TTS)。 中間的 LLM可以決定何時停止,也可以模擬 被 打斷後如何接話 。 它可以輸出未被口頭化的額外「思維軌跡」(也就是它內心的想法),以幫助生成更好的回復。

然後 GPT-4o 直接從 speech1->speech2 進行蒸餾,基於三階段數據的可選輔助損失函式。蒸餾後,這些行為現在內建於模型中,不再輸出中間文本。

系統方面, 如果每個視訊幀都解壓縮為 RGB 影像,則延遲將無法滿足即時閾值。OpenAI 可能已經開發了自己的神經優先、即時視訊編解碼器,將運動增量作為 token 進行傳輸。通訊協定和神經網路推理必須共同最佳化。 例如,可以在邊緣裝置上執行一個小型、高能效的神經網路,如果視訊有趣,它就會決定傳輸更多 token,反之則更少。

我沒想到 GPT-4o 會更接近傳聞中的 GPT-5,即「Arrakis」模型,它能實作多模態輸入和輸出。 實際上,它可能是 GPT-5 的一個早期檢查點 ,尚未完成訓練。

品牌命名也透露出某種不安全感。 在 Google I/O 之前,OpenAI 寧可超預期地推出 GPT-4.5,也不想因 GPT-5 的高期待而栽跟頭 。 這算是一種爭取時間的明智之舉。

值得註意的是,這個語音助手變得更加活潑,甚至有點輕佻。 GPT-4o 正在努力(也許有點太努力了)讓自己聽起來像【 HER 】。 OpenAI 在蠶食 Character AI 的市場份額,兩者在形態上幾乎完全重合,並擁有龐大的分銷渠道 。 這是向更具情感、個性更強的人工智慧發展的一個轉折點, 而 OpenAI 過去似乎一直在積極壓制這一點 。

誰先贏得蘋果,誰就將大獲全勝 。 我認為與 iOS 的整合有三個層次:

1. 放棄 Siri。 OpenAI 為 iOS 精簡出一個純粹的裝置端 GPT-4o,可選擇付費升級以使用雲服務。

2. 將網路攝影機或螢幕串流到模型中的本地功能。芯片級支持神經音訊/視訊編解碼器。

3. 深度融入 iOS 行動介面和智慧家居生態。Siri Shortcuts 曾遭冷遇,但這次,它將以十億使用者級別的 AI 助手身份華麗回歸。 智慧型手機的 FSD,具有特斯拉級別的數據飛輪 。

Jim Fan 文中提到的 HER 正是 Sam Altman 在釋出會前暗示的那部電影。這部由 Spike Jonze 執導的電影【Her】是一部科幻愛情片,設定在未來不遠的洛杉磯。故事圍繞一位名叫狄奧多·托姆布雷(Theodore Twombly)的男子展開,他是一名信件代筆人,專門為那些不善於表達情感的人撰寫感人信件。狄奧多生活在一個高度發達的科技世界中,人類與技術的互動變得日益親密和復雜。

而本次演示的 ChatGPT,其聲音幾乎和電影裏的「Her」一模一樣——電影的女主角正是一款先進的人工智慧作業系統 OS1,這個系統具有高度發達的人格化特征,並自稱薩曼莎(Samantha)。OpenAI 用非常浪漫的方式完成了一次致敬。

如果你對這場直播還沒看夠,那麽 OpenAI 聯合創始人

Greg Brockman

肯定能滿足你的需求。

Greg

直接在 X 上追加了五分鐘的演示視訊,讓 ChatGPT 即興創作了一首歌曲,歌詞中巧妙融入了房間的裝潢風格、在場人物的穿著特色以及其間發生的趣事:

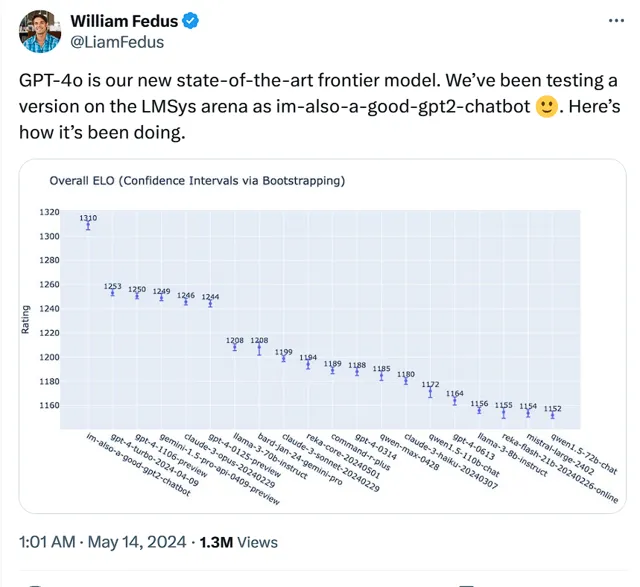

進一步解析:原來你就是 gpt2?

釋出會剛結束,OpenAI 技術人員 William Fedus 便在 X 上釋出了一項重磅訊息。此人師承「AI 三巨頭」之一的 Yoshua Bengio,還曾在 Google Brain 鍍過金。

Fed

us 表示,前段時間在「AI 競技場」 LMSys 打遍天下無敵手的「

im-also-a-good-gpt2-chatbot

」,其實就是 GPT-4o!並且,

Fed

us 還公布了一則更詳細的數據:

Fed us 說, ELO 評分最終可能會受到提示難度的限制(即,在諸如「最近怎麽樣」這樣的提示上無法達到任意高的勝率)。 且他們發現,在 更難的提示集上——尤其是編程任務中——這種差距甚至更大: GPT-4o 相比 OpenAI 之前最好的模型,ELO 評分高出 100 多分 。 差距大 到令人絕望。

下一環節,讓我們深入本次釋出的詳細內容,看看 ChatGPT 和 GPT-4o 未來的釋出計劃都有哪些。

詳細釋出內容

OpenAI 宣稱, GPT-4o 在理解和探討使用者分享的圖片方面已超越所有現存模型 。舉例來說,你只需拍攝一份外語選單,GPT-4o 就能幫你轉譯內容、了解菜品背後的文化故事並提供建議。未來,技術升級將實作更加流暢、即時的語音互動,以及透過即時視訊與 ChatGPT 對話的能力。比如,我們可向 ChatGPT 展示正在進行的體育賽事,讓它講解規則。接下來數周內,OpenAI 將啟動帶有這些新功能的語音模式 Alpha 測試,Plus 使用者將首批體驗,隨後逐步擴大覆蓋範圍。

目前,ChatGPT 已支持超過 50 種語言,覆蓋註冊、登入、使用者設定等多個環節。 GPT-4o 正逐步向 ChatGPT Plus 和團隊使用者開放,企業版也將很快面世 。 同時,免費使用者今日起也可體驗,但設有使用配額 。Plus 使用者的訊息發送上限 將是免費使用者的 5 倍,團隊和企業使用者則享有更高額度。

借助 GPT-4o,免費使用者將能體驗:

GPT-4 級別的智慧互動

結合模型與網路的回復

數據分析與圖表制作

圖片話題討論

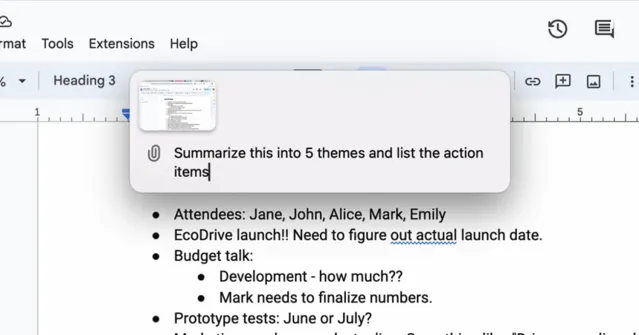

檔上傳以輔助總結、創作或分析

探索並使用 GPT 及 GPT 商店

利用記憶功能構建更佳體驗

根據使用量和需求,免費使用者使用 GPT-4o 的訊息數量將有限制。一旦達到上限,ChatGPT 將自動切換至 GPT-3.5,確保對話延續。

無論是免費還是付費使用者,OpenAI 都推出了全新的 macOS ChatGPT 桌面套用,無縫融入日常電腦操作。只需要簡單快捷鍵(Option + Space)即可隨時提問 ChatGPT,還能直接在套用內截圖並討論。 從今天開始,使用者就可以直接透過電腦與 ChatGPT 進行語音交流,初期會以 Voice Mode 形式呈現,未來將整合 GPT-4o 的音訊視訊新功能 。無論是公司創意頭腦風暴、面試準備還是話題探討,只需點選桌面套用右下角的耳機圖示即可開始語音對話。

參數 pk 環節

GPT-4o 能在 232 毫秒內對音訊輸入做出反應,平均反應時間為 320 毫秒,這與人類在對話中的反應時間相近。

未來,就變成了我們講話比 ChatGPT 慢半拍了……

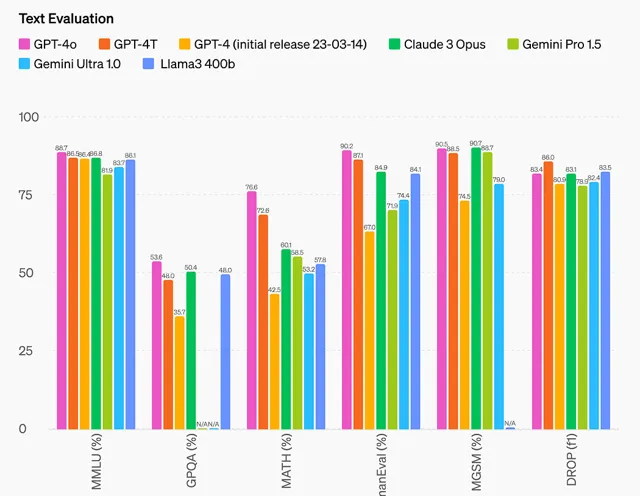

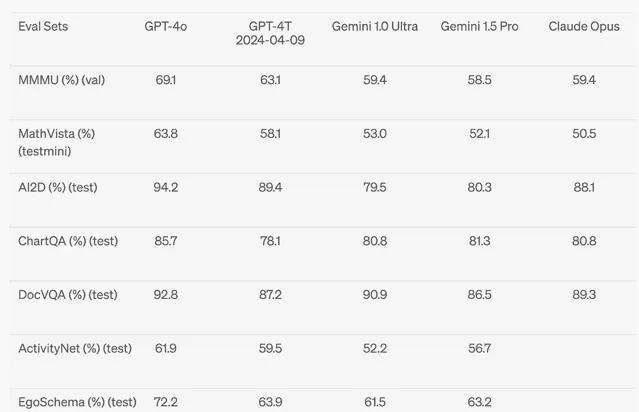

GPT-4o 在英語和程式碼文本方面的效能與 GPT-4 Turbo 相當 ,在非英語語言文本方面也有顯著提高,同時在應用程式介面(API)方面速度更快, 價格便宜 50% 。與現有模型相比,GPT-4o 在視覺和音訊理解方面尤其出色。

本次升級是多模態方面的飛躍,我們會發現 GPT-4o 的文本、推理和編碼水平仍和 GPT-4 Turbo 相當。

真正「遙遙領先」的,顯然是多語種互動、音訊對話、視覺等方面。

最後總結,從今天開始,GPT-4o 強大的文本理解與影像處理能力會逐步融入 ChatGPT。不僅限於免費使用者群體, Plus 使用者更能享受到高達標準使用者 5 倍的訊息發送限額 。此外,一個整合了 GPT-4o 的語音模式 Alpha 版本,預計在未來數周內登陸 ChatGPT Plus。

對於開發者而言,GPT-4o 現已透過 API 開放,成為可呼叫的文本和視覺辨識模型。 與 GPT-4 Turbo 相比,它在速度上快出兩倍,成本減半,且請求頻率上限提升至原來的五倍 。

最後的最後,以一個令人尷尬 的推文結 尾 。

1 5 日的 GoogleIO 大會,CSDN AI 科技大本營仍將繼續奉上詳細資訊整理,歡迎繼續關註。