整理丨王軼群

責編丨唐小引

出品丨AI 科技大本營(ID:rgznai100)

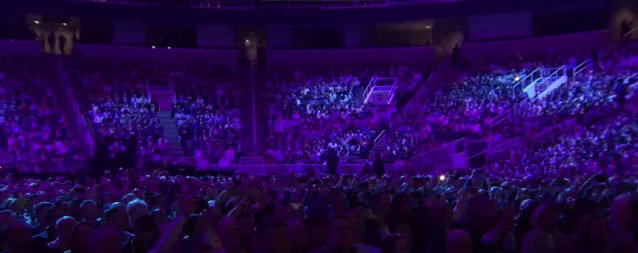

台北時間淩晨4點,天還未亮,美國加利福尼亞州聖荷西SAP中心內已是星光璀璨。聚光燈打在黃仁勛的身上,輝達的技術盛宴GTC 2024吸引了全世界的目光。AI科技大本營帶你直擊輝達GTC2024現場。

「我希望你們意識到,這不是一場音樂會,你們來參加的是一場開發者盛會。」黃仁勛在開場時說道。

(GTC2024盛況如同演唱會現場)

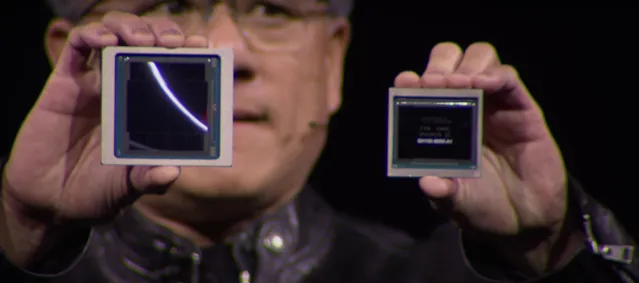

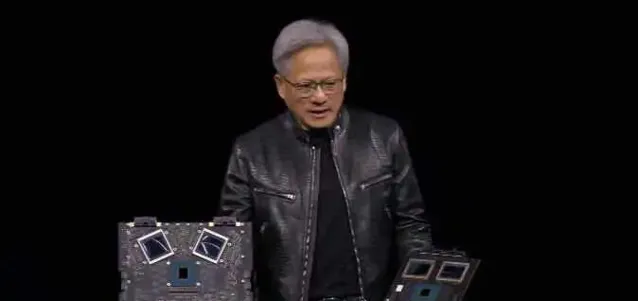

作為輝達 2024 的開年大戲,身著標誌性皮夾克黃教主站在舞台中央,釋出了繼H100、A100 後的又一系列「核彈」級超級芯片——Blackwell 架構系列芯片,包括B200和GB200系列芯片。

史上最強AI芯片

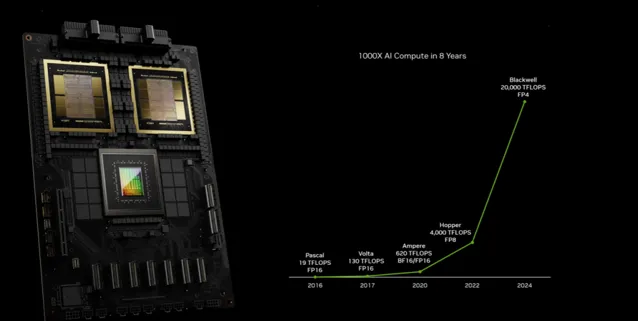

新一代AI圖形處理器被命名為Blackwell。該GPU平台以數學家David Harold Blackwell命名。據輝達稱,Blackwell架構系列芯片是迄今為止功能最強大的AI芯片系列。

(黃仁勛展示繼Hopper之後的Blackwell)

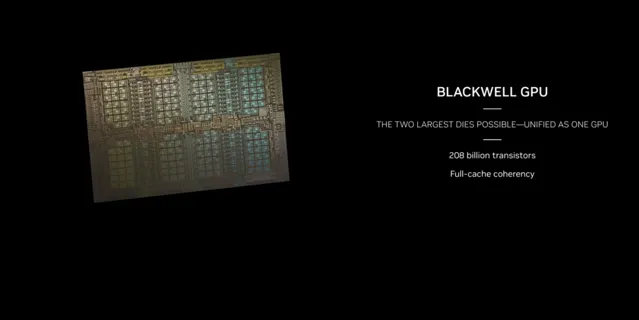

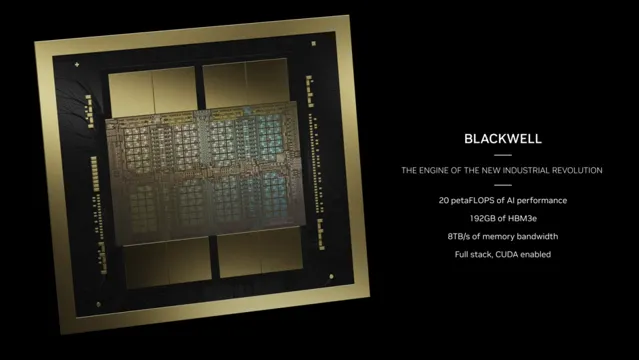

據黃仁勛介紹,B200擁有2080億個晶體管(而 H100/H200 上有 800 億個晶體管),采用台積電4NP工藝制程,可以支持多達10萬億個參數的 AI 模型,而 OpenAI 的 GPT-3 由 1750 億個參陣列成。它還透過單個 GPU 提供20 petaflops(每秒千萬億次浮點運算)的AI效能——單個H100最多可提供 4 petaflops的AI計算。

Blackwell GPU 很大。Blackwell B200並不是傳統意義上的單一GPU。它由兩個緊密耦合的芯片組成,這兩個芯片透過10 TB/s NV-HBI(即Nvidia高頻寬介面)進行連線,以確保它們能夠作為單個一致的芯片正常執行。

Blackwell架構在 AI 安全方面又向前邁進了重要一步。Blackwell透過100%系統內自測試RAS服務和全效能加密提供安全的AI,也就是說數據不僅在傳輸過程中安全,而且在靜止狀態和計算時也安全。

GB200將兩個B200 Blackwell GPU與一個基於 Arm的Grace CPU 配對。在具有 1750 億個參數的 GPT-3 基準測試中,輝達表示 GB200 的效能是 H100 的 7 倍,訓練速度是 H100 的 4 倍。

輝達沒有提供新 GB200 以及所使用的系統成本。據分析師估計,Nvidia基於Hopper的 H100 每個芯片的成本在 2.5萬美元到 4萬美元之間,整個系統的成本高達20萬美元。

亞馬遜、谷歌、微軟和甲骨文將透過雲服務出售 GB200 的存取許可權。輝達表示,AWS、戴爾科技、谷歌、Meta、微軟、OpenAI 和特斯拉計劃使用 Blackwell GPU,其中亞馬遜網路服務將構建一個包含 2萬個 GB200 芯片的伺服器集群。

輝達表示,該系統可以部署27萬億參數的模型。這甚至比最大的模型(例如 GPT-4)還要大得多,據報道 GPT-4 有 1.7 萬億個參數。許多人工智慧研究人員認為,具有更多參數和數據的更大模型可以釋放新功能。

「生成式人工智慧是我們這個時代的決定性技術,」黃仁勛在演講時表示,「Blackwell GPU 是推動這場新工業革命的引擎。與世界上最具活力的公司合作,我們將實作人工智慧對每個行業的承諾。」

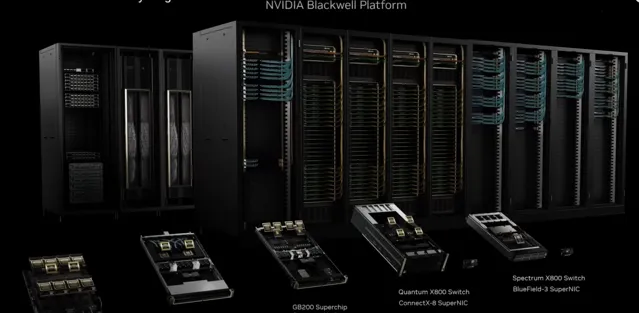

新配套裝置為AI芯片保駕護航

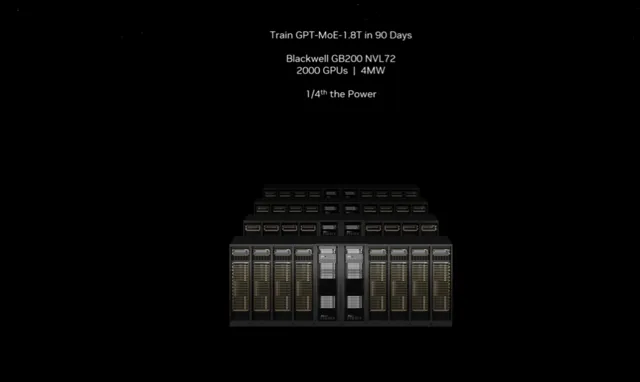

輝達還釋出了 GB200 NVL72 液冷機架系統,其中包含 36 顆 GB200 Grace Blackwell 超級芯片,擁有 1440 petaflops(又名 1.4 exaflops)的推理能力,它內部有近兩英裏長的電纜,共有 5000 根單獨的電纜。

輝達表示,與用於推理用途的相同數量的 H100 Tensor Core 圖形處理單元相比,GB200 NVL72 效能提升高達 30 倍。此外,該系統還可將成本和能耗降低多達 25 倍。

例如,訓練一個 1.8 萬億參數模型之前需要 8000 個 Hopper GPU 和 15 百萬瓦的功率。如今,只需要 2000 個 Blackwell GPU 就可以做到這一點,而功耗僅為 4 百萬瓦。

此外,輝達稱還將推出一款名為 HGX B200 的伺服器主機板,它基於在單個伺服器節點中使用 8個B200 GPU和一個x86 CPU(可能是兩個 CPU)。每個B200 GPU 可配置高達1000W,並且 GPU 提供高達 18 petaflops 的 FP4 吞吐量,因此比 GB200 中的GPU慢10%。

目前,企業客戶可以透過 HGX B200 和 GB200(將 B200 GPU 與 輝達的 Grace CPU 結合在一起)存取 B200。

首款人形機器人模型

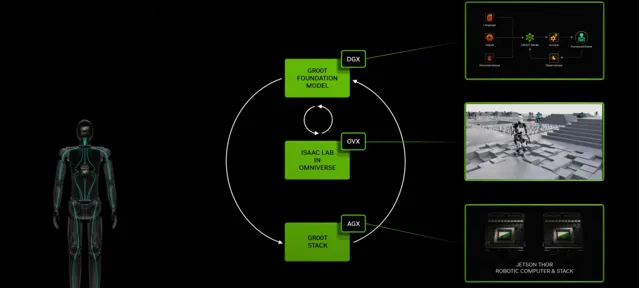

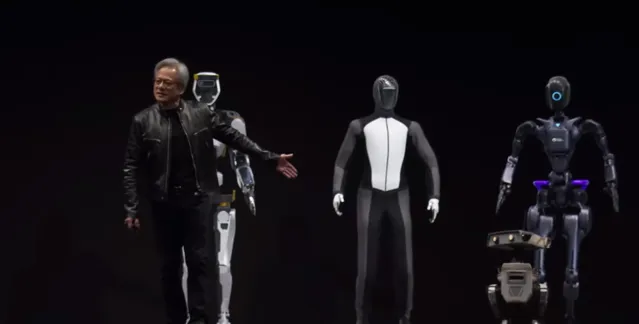

輝達還釋出了人形機器人通用基礎模型Project GROOT,希望透過釋出這個新API集合 Project GROOT來推動人形機器人的開發。黃仁勛表示:「這是AI領域中最令人興奮的課題之一。」

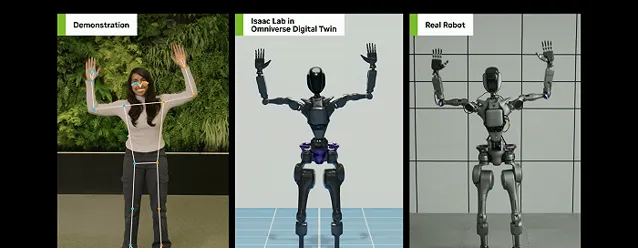

Project GROOT 是一個人形機器人模型,與 Jetson Thor 一起生產。Jetson Thor 是一款 SoC,也是 Nvidia Isaac的升級版。輝達表示,GROOT 機器人將理解自然語言並模仿人類動作來學習靈活性。Jetson Thor 執行基於 Blackwell 的 GPU,可在 8 位數據處理中提供 800 teraflops 的 AI 效能。

GROOT驅動的機器人將能夠理解自然語言,並透過觀察人類行為來模仿動作。其能快速學習協調各種技能,具備更好的靈活性,以適應現實世界並與之互動。在黃仁勛的演講中,他透過視訊展示了數台這樣的機器人是如何完成各種任務的。

其中包括醫療和物流搬運、分揀用的機械臂,以及可以做打果汁等家務的人形家用機器人,還有的機器人可以模仿人類打架子鼓,也能夠從視訊中學習人類的舞蹈動作並進行模擬。基於大語言模型,有的人形機器人還可以理解人類的口頭指令,並做出回應。

輝達正在為人形機器人公司開發一個綜合的AI平台,如1X Technologies、Agility Robotics、Apptronik、波士頓動力公司等等。

(來到演講現場的迪士尼機器人Green)

「下一代機器人很有可能是人形機器人,因為我們有更多的模仿訓練數據可以提供給和我們構造相似的機器人們。人形機器人可以更有效率地部署在人類設計的工作站、制造和物流環節中。」黃仁勛說。

推理微服務NIM

在GTC 2024上,輝達還推出了名為NIM(Nvidia Inference Microservice)的推理微服務。該軟體將使人工智慧的部署變得更加容易。輝達高管表示,該公司正在不再是一個唯利是圖的芯片提供商,而更像是一個平台提供商,就像微軟或蘋果一樣,其他公司可以在平台上構建軟體。

NIM 使使用舊版 Nvidia GPU 進行推理或執行人工智慧軟體的過程變得更加容易,並將允許公司繼續使用他們已經擁有的數億個 Nvidia GPU。與新人工智慧模型的初始訓練相比,推理所需的計算能力更少。NIM 使想要執行自己的 AI 模型的公司能夠使用,而不是從 OpenAI 等公司購買 AI 結果作為服務。

輝達將與微軟或 Hugging Face 等人工智慧公司合作,確保他們的人工智慧模型能夠在所有相容的輝達芯片上執行。然後,使用 NIM,開發人員可以在自己的伺服器或基於雲的輝達伺服器上高效地執行模型,而無需冗長的配置過程。

輝達表示,該軟體還將幫助人工智慧在配備 GPU 的膝上型電腦上執行,而不是在雲端伺服器上執行。

「Hopper 太棒了,但我們需要更大的 GPU。」黃仁勛加在開發者大會上表示,「Blackwell 不是芯片,而是一個平台的名稱。」

(黃仁勛展示Blackwell架構的平台能力)

此前,輝達副總裁Manuvir Das在接受采訪時表示。「可銷售的商業產品是GPU,而軟體都是為了幫助人們以不同的方式使用 GPU,當然,我們仍然這樣做。但真正改變的是,我們現在真正擁有了商業軟體業務。」Das表示,Nvidia的新軟體將使在任何 Nvidia GPU 上運行程式變得更加容易,甚至是那些可能更適合部署但不適合構建人工智慧的舊 GPU。

Das說:「如果你是一名開發人員,你有一個有趣的模型,希望人們采用,如果你將它放入 NIM 中,我們將確保它可以在我們所有的 GPU 上執行,這樣你就能接觸到很多人。」

擁抱AI,共赴未來

黃仁勛表示輝達已經推出了數十種企業級生成式 AI 微服務,企業可以使用這些服務在自己的平台上制作應用程式,同時保留對其智慧財產權的完全所有權和控制權。他還宣布將Omniverse Cloud流傳輸至Apple Vision Pro耳機。

黃仁勛表示,輝達表示正認真考慮從根本上重新設計整個底層軟體堆疊,希望借 AI 之力為人類生成更優質的程式碼。之所以會有這樣的想法,原因非常簡單:幾十年來,整個世界一直受制於圍繞 CPU 發展出的傳統計算框架,即由人類編寫應用程式以檢索資料庫中準備好的資訊。

黃仁勛在釋出會上指出,「我們今天的計算方式,首先需要確定資訊是由誰編寫、由誰建立的,也就是要求資訊先要被記錄下來。」而輝達的 GPU 為加速計算開辟出一條通往演算法化計算的新路,可以依托創造性推理(而非固有邏輯)來確定相關結果。

黃仁勛表示,「未來,我們將步入持續學習的時代。我們可以決定是否部署持續學習的成果,而且與電腦的互動不會再借助 C++。」

黃仁勛認為, 英語將成為最強大的程式語言,而個人化互動則是縮小技術鴻溝的關鍵因素 。

黃仁勛表示,大語言模型將幫助人類透過電腦把自己的靈感轉化為現實,也就是說人類將可以專註於領域專業知識,而生成式 AI 將補齊編程技能這塊短板。黃仁勛認為這將徹底顛覆軟體的開發格局。

AI時代,讓我們聯合廣大開發者一起,共赴未來。

相關 連結 :

https://www.youtube.com/watch?v=Y2F8yisiS6E

https://www.cnbc.com/2024/03/18/nvidia-announces-gb200-blackwell-ai-chip-launching-later-this-year.html

4 月 25 ~ 26 日,由 CSDN 和高端 IT 咨詢和教育平台 Boolan 聯合主辦的「 全球機器學習技術大會 」將在上海環球港凱悅酒店舉行,特邀近 50 位技術領袖和行業套用專家,與 1000+ 來自電商、金融、汽車、智慧制造、通訊、工業互聯網、醫療、教育等眾多行業的精英參會聽眾,共同探討人工智慧領域的前沿發展和行業最佳實踐。 歡迎所有開發者朋友存取官網 http://ml-summit.org、點選「閱讀原文」或掃碼 進一步了解詳情。