商 界 導 讀:史上最聰明的大騙局來襲。

「人工智慧之父」傑佛瑞·欣頓有個末日預言:人工智慧可能對人類構成巨大威脅。因為, 「很難找到防止壞人用它做壞事的方法」 。

不幸的是,這一預言正成為現實。

1

高端局來了

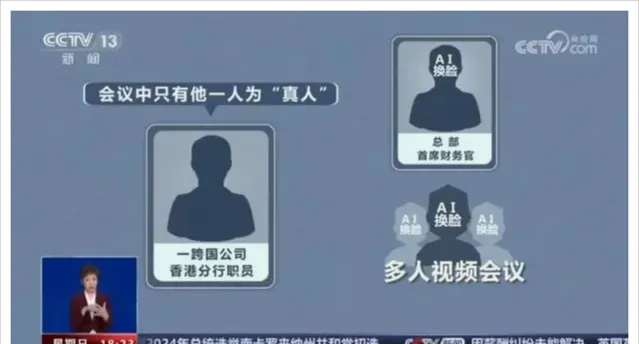

一個跨國公司白領,一杯咖啡的功夫,就讓公司損失了2億港元。

原因是,他被邀請參加了一場公司高管的視訊會議,總部財務長在會上要求他馬上給幾個帳戶共轉賬2個億,在其他同事的配合下,他當場就把事情辦妥了。

但事實上,這場會議就是個騙局,整場視訊會議的出席者,只有他一個「真人」!

這是香港警方近期披露的一起多人「AI換臉」詐騙案。被詐騙職員親眼見到的所有人、親耳聽到的所有聲音,全都來自經過「AI換臉、換聲」的詐騙人員。

這位員工並非是沒有警惕的「二楞子」。

最初收到英國總部CFO的信件,稱公司正在計劃一個「秘密交易」,需要他將公司資金轉到幾個香港本地帳戶中待用時,他並沒有相信,而且認為這是釣魚詐騙信件。

但當騙子給他撥了個視訊電話,而且還邀請了其他幾位「真實親切」的同事在旁協助時,他徹底放下了戒備。

甚至, 事件發生5天之後,他在向英國公司求證時才發現自己被騙了。

同樣可怕的「遭遇」,也發生在福州市某科技公司法人代表郭先生身上。

2023年4月20日,一位好友突然打了個微信視訊:「老郭,我一個朋友在外地競標,需要430萬保證金。你看看能不能先走你的公司帳戶,幫忙過個賬?」

好友說錢已打過來,還發了銀行轉賬底單截圖。

因為是視訊聊天,郭先生就沒核實錢是否到賬,直接給對方帳戶轉了430萬。

事後,郭先生給好友打了電話,稱「事情辦妥了」,對方卻驚訝回應完全沒有這回事。

9分鐘,430萬沒了!

坑了郭先生的,也是AI詐騙。

綜合公開資訊,這種讓人防不勝防的騙局,一般分三步:

1.不法分子用AI機器人騷擾電話,獲取用來行騙的目標物件的聲音素材,然後進行聲音偽造;

2.盜取目標物件的社交帳號,尋找受害人;

3.用AI換臉技術,和受害人視訊通話,博取信任,實施詐騙。

三步下來,以往「發個語音」、「打個視訊」的防詐手段,在AI詐騙面前基本失效。

更可怕的是,掌握AI的騙子,越來越多了!

公開資訊顯示,2021年以來多個省份都出現了AI詐騙及不當牟利案件。中國互聯網協會2023年5月24日稱,利用「AI換臉」「AI換聲」等進行詐騙、誹謗的違法行為屢見不鮮。

當傳統認知裏,受騙物件還多是經不起誘惑、社會經驗少的「冤大頭」,以及一些不常上網的老年人。

只要給幾張照片和幾秒語音,就能復刻出「真人」的AI詐騙,卻讓每個人都可能難逃一劫。

比如假扮大學同學、親戚、供貨商等AI視訊借錢案件,就層出不窮。

如果覺得從不借錢便不會中招,就太天真了。

當騙子偽裝成領導,以匯款、資金周轉等緊急理由,要求下屬立即轉賬,很少有人能頂住壓力。更有甚者,騙子直接偽造子女、父母車禍入院等借口,利用親人感情實施欺詐。

據湖北網警巡查執法公布訊息,AI技術新騙局詐騙成功率竟接近100%,其成功率之高、涉案金額之大、詐騙速度之快令人咋舌。

更令人毛骨悚然的是,資訊泄露、私密不安全的普遍現實,為AI詐騙造就了「天然溫床」。

2023年2月15日,一則「幾乎無人幸免,疑似45億條電商或快遞資訊泄露」的訊息,沖上熱搜。有網友忍不住吐槽:「要有多強的防範意識,才能想到跟你視訊通話的親友,不是一個大活人啊?要有多強的私密意識,才能保證自己資訊不泄露或被竊取?」

微博大V@全民防詐騙,甚至因此預言:「你目前還沒被騙,並不是因為你多聰明,也不是因為你沒錢,而是適合你的‘劇本’還在路上。」

2

全球大爆發

2023年4月末,一位叫詹妮弗·德斯特凡諾的美國母親突然接到電話:「媽媽,救命!」

眼看大女兒布萊恩娜似乎陷入了大麻煩,詹妮弗嚇呆了。

接下來便是對方威脅:

「如果你打電話報警,就永遠別想再見到她了!」

掛斷後,詹妮弗立馬要給贖金。

幸運的是,女兒正好打來電話,騙局不攻自破。但心有余悸的她仍無比驚訝:

「就算隔一棟樓,我也不會認錯自己孩子的哭泣聲。」

詹妮弗想不到的是,突飛猛進的AI技術,早已比一個母親更了解自己的孩子。而騙子支付的代價,可能還不到每月5美元。

2017年,名為「Deepfakes」的網友,利用AI技術釋出了將色情演員換臉成蓋爾·加朵等名人的視訊片段,引發軒然大波。

被稱為「深度偽造」(Deepfake)的AI換聲及換臉技術,自此進入大眾視野。

一些從事類似詐騙的不法分子,立馬盯上了這一先進技術。

2019年3月,一詐騙犯借助連「微妙的德國口音」也毫無破綻的AI換聲技術,冒充一家英國能源公司大老板,忽悠其高管轉了22萬歐元,這被視為全球首例人工智慧詐騙案。

隨後,AI技術流行的歐美,迅速成為AI詐騙的溫床。

美國聯邦調查局年度報告顯示,2022年美國AI詐騙同比上漲了50%到75%,美國網路詐騙損失達103億美元,創五年來新高,面向老年人的AI語音騙局則是重災區。

世界經濟論壇研究與分析主管布魯內曼的調查則顯示,「在過去一年裏,26%的小公司和38%的大公司都經歷過深度偽造欺詐」。她甚至預測:

到2026年,超90%的網路攻擊內容都將是AI合成。

AI詐騙的效果越來越逼真,但技術門檻和成本,卻一直在降低。

美國加州大學柏克萊分校教授法瑞德表示,AI換聲到現在已經只需要十幾秒錄音就能實作,換臉則一張照片就可以。相應的AI使用費,也只需每月5美元到數百美元不等。

這基本上意味著,普通人都能「輕松」進行不法活動。

而且,AI還可以透過資訊收集及大數據分析,智慧篩選出「易騙人群」。比如進行金融詐騙,就可以搜集熱衷關註投資資訊的人群,成為潛在目標。

甚至,AI還能分析目標物件的社群網路,進而掌握其個人化表達方式、人際關系、興趣愛好等生活習慣,實作「詐騙劇本」客製化。

法瑞德因此驚呼:

「這很可怕,就像一場完美的風暴,具備了釀成大禍的所有條件。」

但盡管風險顯而易見,AI語音及視訊合成技術卻仍在狂奔。

今年春節期間,OpenAI文生視訊模型Sora橫空出世,讓AI視訊制作更加簡單、真實。一夜之間,「現實不存在了」的驚嘆,刷遍朋友圈。

當AI簽名、AI視訊、AI換聲換臉等,本應創造美好和便利的高端技術變成壞人手中的「魔杖」,無數人和機構的財產、資訊及現實安全,也越來越形同「裸奔」。

3

沒有真相的時代

「現在已經到了大規模、集中化討論AI風險的關鍵時刻」,清華大學教授沈陽曾如此呼籲。

其實,對AI詐騙的警惕與治理方案,早已在路上。

美國資訊安全中心釋出的【人工智慧與國家安全】,明確將人工智慧偽造技術列為威脅國家安全的重點技術。中國也開始透過政策管理和技術限制等途徑,來應對其潛在安全風險。

但AI詐騙,似乎是打不死的「小強」—— 打擊不斷升級,案件也屢創歷史新高。

根本原因,還是法律法規制定、推廣的建設速度,趕不上AI技術的叠代和傳播速度。產業、大眾對AI危害的反應,也很容易慢半拍。

如今,AI騙局也早已超出「詐騙」範疇,蔓延到社會的各個角落。

今年1月底,明星泰勒·斯威夫特大量AI「不雅照片」在社交平台上傳播,此事甚至震動美國白宮,並掀起一波關於人工智慧的擔憂。

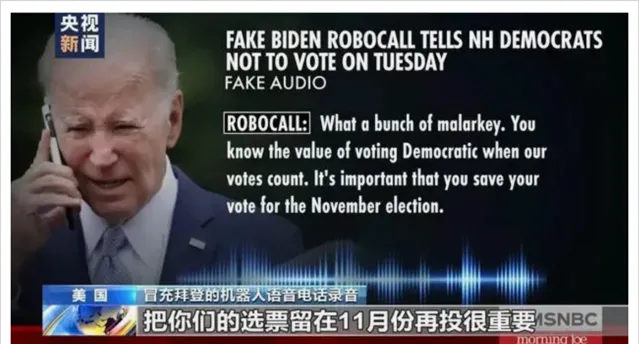

包括白宮,也難以幸免。

上周,很多人都接到了美國總統拜登的AI電話呼叫,要求把選票留給自己而非川普。

這當然也是假的,但不少人還是信了。有人因此認為,AI騙局可能會影響美國大選。

在中國,假新聞、假圖片案件也甚囂塵上。

2023年5月,科大訊飛就受一篇名為【科大訊飛出現重大風險的警示文】的文章影響,股價迅速跳水。公司最後緊急回應,股價下跌系某生成式AI寫作虛假「小作文」導致。

AI越來越方便著人們的生活,但也方便著不法分子們。

2023年4月13日索尼世界攝影獎頒獎禮,大獎得主卻沖上舞台奪過話筒,悲憤地說這是AI偽作。他反問,「如果索尼世界攝影獎的評委都分不清真假照片,其他人還能怎麽辦?」

當AI騙局從專業級走向「平民化」,我們能做的,除了寄望於監管,或許就是:

對家人的電話,視訊等等一切,都要首先報以深深地懷疑。以及把那句,不給任何陌生人匯款變成:

不給任何人匯款。

投資 · 傳媒 · 創新

關 於 本 文

作 者 :耿康祁

來源:華商韜略(ID:hstl8888)

文章為作者獨立觀點,版權歸原作者及原創平台所有。

精 彩 文 章

1.

2.

3.

4.

5.

致力為讀者提供精彩、深度、有料的商業財經內容

為企業提供全媒體品牌策劃、內容創作、推廣傳播

Hi,U can also follow us

出品 | 商界傳媒內容編輯部

投稿/合作/爆料 聯系微信:JEFF_MAIN

你再主動一點點 我們就有故事了